2026.05.28 목요일

검색

'CPU' 검색결과

기간검색

-

~

검색영역

검색어

-

"쓴 만큼만 낸다"…네이버클라우드, 서버리스 DB 출시 [경제일보] 네이버클라우드가 서버리스(Serverless) 기반 데이터베이스(DB) 서비스를 출시하며 AI 시대 클라우드 인프라 시장 공략에 속도를 내고 있다. 생성형 인공지능(AI) 확산으로 기업들의 데이터 처리량과 인프라 비용 부담이 빠르게 증가하는 가운데 사용량에 따라 컴퓨팅 자원을 자동으로 조절하는 차세대 클라우드 운영 수요를 겨냥한 것으로 풀이된다. 12일 네이버클라우드는 데이터베이스 사용량에 따라 서버 자원을 자동으로 확장·축소하는 서버리스 기반 데이터베이스 서비스 '클라우드 DB 서버리스'를 출시했다고 밝혔다. 이번 서비스는 기존 가상머신(VM) 기반 관리형 데이터베이스(DBMS) 구조의 한계를 개선하는 것을 목표로 설계됐다. 기존 클라우드 데이터베이스 환경에서는 기업들이 트래픽 급증 상황에 대비해 서버 자원을 미리 확보해야 했고, 실제 사용량과 관계없이 고정 비용이 발생하는 문제가 지속적으로 제기된 것으로 알려졌다. 특히 생성형 AI 서비스와 AI 에이전트, 실시간 추천 서비스 등이 최근 빠르게 확산되면서 데이터 처리량 변동성이 커지고 서버리스 수요가 확대됐다. AI 서비스 특성상 특정 시간대에 트래픽이 급증하거나 대규모 연산이 집중되는 경우가 늘어나면서 기존 고정형 인프라 구조만으로는 비용 효율 확보의 난이도가 높았다. 이에 글로벌 클라우드 시장에서는 서버리스 기반 데이터베이스 경쟁이 빠르게 확대되고 있다. AWS의 '오로라 서버리스', 구글클라우드의 '클라우드 SQL', 마이크로소프트의 '애저 코스모스DB' 등 주요 글로벌 CSP들도 자동 확장 기반 데이터베이스 서비스를 핵심 전략 상품으로 육성하고 있다. '클라우드 DB 서버리스'는 컨테이너 기반 서버리스 아키텍처를 기반으로 CPU와 메모리, 스토리지 자원을 트래픽 상황에 맞춰 자동으로 조절하는 오토스케일링 기능을 제공한다. 사용량 기반 과금 체계를 적용해 실제 사용한 만큼만 비용을 지불하도록 설계됐다. 이번 서비스는 국내 데이터 규제와 클라우드 보안 요구사항을 충족할 수 있도록 설계됐고, 이에 네이버클라우드는 이번 서비스를 시작으로 공공·금융 시장 공략을 강화할 것으로 전망된다. 향후 공공 리전까지 서비스를 확대하고 다양한 오픈소스 데이터베이스 지원도 강화할 계획이다. 최근 네이버클라우드는 초거대 AI '하이퍼클로바X'와 GPU 기반 AI 데이터센터, 기업용 AI 서비스 확대 등 AI 인프라 사업 전반에 투자를 확대하고 있다. 서버리스 데이터베이스 역시 AI 서비스 운영 효율성을 높이기 위한 핵심 인프라 전략 중 하나로 평가된다. 특히 AI 서비스 확산으로 데이터 저장과 실시간 처리 수요가 급증하면서 향후 클라우드 시장 경쟁도 단순 서버 제공을 넘어 자동화·AI 최적화·비용 효율 경쟁 중심으로 재편될 것으로 전망된다. 네이버클라우드는 이번 출시 과정에서 실시간 사용량 기반 데이터베이스 백업 최적화와 자동 자원 배분 기술 등 독자 특허 2건도 적용했다고 설명했다. 향후 공공·기업 시장을 중심으로 서버리스 기반 데이터베이스 수요 확대에 적극 대응한다는 계획이다. 정승용 네이버클라우드 클라우드 DB 플랫폼 리더는 "'클라우드 DB 서버리스'는 그동안 많은 기업이 겪어온 자원 관리의 번거로움과 비용 낭비를 동시에 해결할 수 있는 최적의 상품"이라며 "사용자가 인프라 운영 부담에서 벗어나 비즈니스에만 온전히 집중할 수 있는 환경을 제공하는 데 집중할 것"이라고 말했다.

"쓴 만큼만 낸다"…네이버클라우드, 서버리스 DB 출시 [경제일보] 네이버클라우드가 서버리스(Serverless) 기반 데이터베이스(DB) 서비스를 출시하며 AI 시대 클라우드 인프라 시장 공략에 속도를 내고 있다. 생성형 인공지능(AI) 확산으로 기업들의 데이터 처리량과 인프라 비용 부담이 빠르게 증가하는 가운데 사용량에 따라 컴퓨팅 자원을 자동으로 조절하는 차세대 클라우드 운영 수요를 겨냥한 것으로 풀이된다. 12일 네이버클라우드는 데이터베이스 사용량에 따라 서버 자원을 자동으로 확장·축소하는 서버리스 기반 데이터베이스 서비스 '클라우드 DB 서버리스'를 출시했다고 밝혔다. 이번 서비스는 기존 가상머신(VM) 기반 관리형 데이터베이스(DBMS) 구조의 한계를 개선하는 것을 목표로 설계됐다. 기존 클라우드 데이터베이스 환경에서는 기업들이 트래픽 급증 상황에 대비해 서버 자원을 미리 확보해야 했고, 실제 사용량과 관계없이 고정 비용이 발생하는 문제가 지속적으로 제기된 것으로 알려졌다. 특히 생성형 AI 서비스와 AI 에이전트, 실시간 추천 서비스 등이 최근 빠르게 확산되면서 데이터 처리량 변동성이 커지고 서버리스 수요가 확대됐다. AI 서비스 특성상 특정 시간대에 트래픽이 급증하거나 대규모 연산이 집중되는 경우가 늘어나면서 기존 고정형 인프라 구조만으로는 비용 효율 확보의 난이도가 높았다. 이에 글로벌 클라우드 시장에서는 서버리스 기반 데이터베이스 경쟁이 빠르게 확대되고 있다. AWS의 '오로라 서버리스', 구글클라우드의 '클라우드 SQL', 마이크로소프트의 '애저 코스모스DB' 등 주요 글로벌 CSP들도 자동 확장 기반 데이터베이스 서비스를 핵심 전략 상품으로 육성하고 있다. '클라우드 DB 서버리스'는 컨테이너 기반 서버리스 아키텍처를 기반으로 CPU와 메모리, 스토리지 자원을 트래픽 상황에 맞춰 자동으로 조절하는 오토스케일링 기능을 제공한다. 사용량 기반 과금 체계를 적용해 실제 사용한 만큼만 비용을 지불하도록 설계됐다. 이번 서비스는 국내 데이터 규제와 클라우드 보안 요구사항을 충족할 수 있도록 설계됐고, 이에 네이버클라우드는 이번 서비스를 시작으로 공공·금융 시장 공략을 강화할 것으로 전망된다. 향후 공공 리전까지 서비스를 확대하고 다양한 오픈소스 데이터베이스 지원도 강화할 계획이다. 최근 네이버클라우드는 초거대 AI '하이퍼클로바X'와 GPU 기반 AI 데이터센터, 기업용 AI 서비스 확대 등 AI 인프라 사업 전반에 투자를 확대하고 있다. 서버리스 데이터베이스 역시 AI 서비스 운영 효율성을 높이기 위한 핵심 인프라 전략 중 하나로 평가된다. 특히 AI 서비스 확산으로 데이터 저장과 실시간 처리 수요가 급증하면서 향후 클라우드 시장 경쟁도 단순 서버 제공을 넘어 자동화·AI 최적화·비용 효율 경쟁 중심으로 재편될 것으로 전망된다. 네이버클라우드는 이번 출시 과정에서 실시간 사용량 기반 데이터베이스 백업 최적화와 자동 자원 배분 기술 등 독자 특허 2건도 적용했다고 설명했다. 향후 공공·기업 시장을 중심으로 서버리스 기반 데이터베이스 수요 확대에 적극 대응한다는 계획이다. 정승용 네이버클라우드 클라우드 DB 플랫폼 리더는 "'클라우드 DB 서버리스'는 그동안 많은 기업이 겪어온 자원 관리의 번거로움과 비용 낭비를 동시에 해결할 수 있는 최적의 상품"이라며 "사용자가 인프라 운영 부담에서 벗어나 비즈니스에만 온전히 집중할 수 있는 환경을 제공하는 데 집중할 것"이라고 말했다.2026-05-12 14:24:07

-

'K-엔비디아' 현실로…SKT, 데이터센터서 국산 반도체 검증 진행 [경제일보] 국산 인공지능(AI) 반도체를 실제 서비스에 적용하는 실증이 본격화되면서 'K-엔비디아'로 불리는 국내 AI 반도체 육성 전략이 현장 단계로 진입하고 있다. 정부의 대규모 투자 계획과 민간 기업의 인프라 구축이 맞물리며 소버린 AI 구현을 위한 생태계 조성이 속도를 내고 있는 것으로 풀이된다. 29일 SK텔레콤은 과학기술정보통신부가 인천에 위치한 SK텔레콤 AI 서비스 전용 데이터센터를 방문해 국산 NPU(신경망처리장치) 적용 현황을 점검했다고 밝혔다. 이번 점검은 정부가 추진 중인 'K-엔비디아 육성 프로젝트'의 일환으로 AI 반도체의 실제 적용 사례를 확인하기 위해 마련된 것으로 알려졌다. 현장에는 과기정통부 관계자와 함께 국내 AI 반도체 기업 리벨리온 경영진이 동행했고 데이터센터 내 국산 NPU 기반 서버 운영 상황이 공유됐다. 현재 해당 데이터센터에는 리벨리온의 데이터센터용 NPU '아톰'과 '아톰 맥스'를 탑재한 서버가 구축돼 실제 서비스에 활용되고 있다. SK텔레콤은 해당 데이터센터의 NPU를 자사 AI 서비스에 적용하고 있다. 통화 내용을 자동으로 정리하는 '에이닷'과 통화 요약 기능, 반려동물 영상 진단 보조 서비스 '엑스칼리버' 등에 국산 NPU가 활용되고 있다. 특히 자체 거대언어모델(LLM) '에이닷엑스'를 기반으로 하루 최대 5000만건 규모의 API 호출을 처리하며 국산 LLM과 국산 반도체를 결합한 소버린 AI의 구현을 진행하고 있다. 최근 정부는 'K-엔비디아 육성 프로젝트'를 통해 AI·반도체 분야에 대규모 자금을 투입하고 있다. 국민성장펀드를 활용해 5년간 50조원, 올해 10조원 규모의 자금을 공급하고 오는 2030년까지 글로벌 수준의 AI 반도체 기업을 육성한다는 목표다. AI 반도체 시장은 빠르게 성장하는 분야로 꼽힌다. 미국의 IT 리서치 기업 가트너는 글로벌 AI 반도체 시장이 지난 2024년 818억 달러(약 121조원) 규모에서 오는 2029년까지 3902억 달러(약 577조원) 규모까지 연평균 30% 이상 성장할 것으로 전망했다. 시장의 성장을 따라가기 위해 정부는 단순 칩 개발을 넘어 소프트웨어와 모델, 서비스까지 포함한 '풀스택' 실증이 필요하다는 입장이다. 실제 서비스 환경에서 성능과 경제성을 검증해야 글로벌 경쟁력을 확보할 수 있다는 판단으로 풀이된다. 이에 SK텔레콤과 리벨리온은 글로벌 반도체 설계 기업 Arm과 협력해 CPU와 NPU를 결합한 AI 추론 서버 개발에 착수했고 향후 자체 AI 모델을 해당 인프라에서 운영하는 방안도 검토 중인 것으로 알려졌다. 또한 양사는 정부의 독자 AI 파운데이션 모델 프로젝트에도 함께 참여하며 기술 검증과 상용화를 병행하고 있다. SK텔레콤은 자회사 사피온코리아와 리벨리온의 합병 이후 지분 관계를 기반으로 협력을 강화하며 데이터센터와 서비스 전반에 국산 NPU 적용을 확대할 전망이다. SK텔레콤 관계자는 "국가 간 AI 기술 경쟁이 심화되는 가운데 국내 AI 생태계의 자립성 강화는 국가 경쟁력을 좌우하는 핵심 요소"라며 "국산 LLM이 국산 NPU를 통해 서비스되는 '소버린 AI'를 확대해 나갈 계획"이라고 말했다.

'K-엔비디아' 현실로…SKT, 데이터센터서 국산 반도체 검증 진행 [경제일보] 국산 인공지능(AI) 반도체를 실제 서비스에 적용하는 실증이 본격화되면서 'K-엔비디아'로 불리는 국내 AI 반도체 육성 전략이 현장 단계로 진입하고 있다. 정부의 대규모 투자 계획과 민간 기업의 인프라 구축이 맞물리며 소버린 AI 구현을 위한 생태계 조성이 속도를 내고 있는 것으로 풀이된다. 29일 SK텔레콤은 과학기술정보통신부가 인천에 위치한 SK텔레콤 AI 서비스 전용 데이터센터를 방문해 국산 NPU(신경망처리장치) 적용 현황을 점검했다고 밝혔다. 이번 점검은 정부가 추진 중인 'K-엔비디아 육성 프로젝트'의 일환으로 AI 반도체의 실제 적용 사례를 확인하기 위해 마련된 것으로 알려졌다. 현장에는 과기정통부 관계자와 함께 국내 AI 반도체 기업 리벨리온 경영진이 동행했고 데이터센터 내 국산 NPU 기반 서버 운영 상황이 공유됐다. 현재 해당 데이터센터에는 리벨리온의 데이터센터용 NPU '아톰'과 '아톰 맥스'를 탑재한 서버가 구축돼 실제 서비스에 활용되고 있다. SK텔레콤은 해당 데이터센터의 NPU를 자사 AI 서비스에 적용하고 있다. 통화 내용을 자동으로 정리하는 '에이닷'과 통화 요약 기능, 반려동물 영상 진단 보조 서비스 '엑스칼리버' 등에 국산 NPU가 활용되고 있다. 특히 자체 거대언어모델(LLM) '에이닷엑스'를 기반으로 하루 최대 5000만건 규모의 API 호출을 처리하며 국산 LLM과 국산 반도체를 결합한 소버린 AI의 구현을 진행하고 있다. 최근 정부는 'K-엔비디아 육성 프로젝트'를 통해 AI·반도체 분야에 대규모 자금을 투입하고 있다. 국민성장펀드를 활용해 5년간 50조원, 올해 10조원 규모의 자금을 공급하고 오는 2030년까지 글로벌 수준의 AI 반도체 기업을 육성한다는 목표다. AI 반도체 시장은 빠르게 성장하는 분야로 꼽힌다. 미국의 IT 리서치 기업 가트너는 글로벌 AI 반도체 시장이 지난 2024년 818억 달러(약 121조원) 규모에서 오는 2029년까지 3902억 달러(약 577조원) 규모까지 연평균 30% 이상 성장할 것으로 전망했다. 시장의 성장을 따라가기 위해 정부는 단순 칩 개발을 넘어 소프트웨어와 모델, 서비스까지 포함한 '풀스택' 실증이 필요하다는 입장이다. 실제 서비스 환경에서 성능과 경제성을 검증해야 글로벌 경쟁력을 확보할 수 있다는 판단으로 풀이된다. 이에 SK텔레콤과 리벨리온은 글로벌 반도체 설계 기업 Arm과 협력해 CPU와 NPU를 결합한 AI 추론 서버 개발에 착수했고 향후 자체 AI 모델을 해당 인프라에서 운영하는 방안도 검토 중인 것으로 알려졌다. 또한 양사는 정부의 독자 AI 파운데이션 모델 프로젝트에도 함께 참여하며 기술 검증과 상용화를 병행하고 있다. SK텔레콤은 자회사 사피온코리아와 리벨리온의 합병 이후 지분 관계를 기반으로 협력을 강화하며 데이터센터와 서비스 전반에 국산 NPU 적용을 확대할 전망이다. SK텔레콤 관계자는 "국가 간 AI 기술 경쟁이 심화되는 가운데 국내 AI 생태계의 자립성 강화는 국가 경쟁력을 좌우하는 핵심 요소"라며 "국산 LLM이 국산 NPU를 통해 서비스되는 '소버린 AI'를 확대해 나갈 계획"이라고 말했다.2026-04-29 16:30:00

-

구글 클라우드, 제미나이 에이전트 플랫폼·8세대 TPU 공개 [경제일보] 구글 클라우드가 인공지능(AI) 에이전트와 맞춤형 반도체 시장을 동시에 겨냥한 ‘투트랙 전략’을 본격화했다. 구글은 22일(현지시간) 미국 라스베이거스에서 열린 연례 기술 콘퍼런스 ‘구글 클라우드 넥스트 2026’에서 기업용 AI 에이전트 도구인 ‘제미나이 엔터프라이즈 에이전트 플랫폼’을 공개했다. 동시에 훈련과 추론에 각각 특화된 8세대 TPU(텐서 처리장치) ‘8t’와 ‘8i’를 선보이며 AI 인프라 주도권 확보에 나섰다. 현재 기업용 AI 시장에서 가장 확실한 수익 모델은 개발자 중심의 코딩 도구 분야다. 오픈AI의 코덱스(Codex)와 앤트로픽의 클로드 코드(Claude Code)가 경쟁하는 가운데 구글은 상대적으로 존재감이 약했다. 이를 만회하기 위해 구글이 내놓은 제미나이 엔터프라이즈 에이전트 플랫폼은 코딩 지식이 없는 일반 직원도 AI 에이전트를 직접 만들 수 있도록 설계된 것이 특징이다. 개발자 중심 시장을 건너뛰고 기업 실무 전반으로 확산되는 ‘에이전트 생태계’의 주도권을 선점하겠다는 전략으로 풀이된다. 특히 구글은 자사 모델뿐 아니라 앤트로픽의 클로드 모델까지 선택해 사용할 수 있도록 개방형 구조를 채택했다. 토머스 쿠리안 최고경영자(CEO)는 “단편적 서비스가 아니라 혁신을 위한 포괄적 기반을 제공하는 것”이라고 강조했다. 하드웨어 전략도 대대적으로 재편했다. 구글은 8세대 TPU를 훈련용 ‘8t’와 추론용 ‘8i’로 완전히 분리했다. 대규모 모델 학습에는 연산 성능이 높은 8t를, 실시간 서비스 환경에는 지연을 최소화한 8i를 투입하는 구조다. 8t는 인프라 관리 플랫폼 ‘패스웨이’를 통해 단일 클러스터에서 최대 100만 개 칩을 연결할 수 있는 확장성을 갖췄다. 8i는 칩 내부에 384MB 규모의 정적 램(SRAM)을 탑재해 데이터 처리 속도를 크게 끌어올렸다. 또한 구글은 인텔 CPU 대신 자체 설계한 ‘액시온’ 프로세서를 도입해 전력 효율도 개선했다. 이 같은 전략은 엔비디아의 최근 행보와도 유사하다. 엔비디아는 GPU 중심 구조를 유지하면서 추론 특화 칩을 추가하는 방향으로 사업을 확장하고 있다. 업계에서는 양사가 AI 반도체 시장에서 정면 충돌하는 구도가 형성됐다는 분석이 나온다. 특히 추론 전용 가속기는 AI 에이전트 확산과 함께 수요가 급증하는 분야다. 수백만 개 에이전트가 동시에 작동하는 환경에서는 학습보다 실시간 추론 성능이 핵심이 되기 때문이다. 아민 바닷 구글 수석부사장은 “AI 에이전트 시대에는 훈련과 서비스에 각각 최적화된 칩이 필요하다”고 설명했다. 업계는 이번 발표를 계기로 구글이 반도체부터 데이터센터, AI 모델, 개발 도구까지 아우르는 ‘AI 수직계열화’를 완성 단계에 올렸다고 평가한다. 구글은 2015년부터 자체 칩을 설계·운용해온 경험을 강점으로 내세우고 있다. 여기에 자체 모델 ‘제미나이’도 챗GPT, 클로드와 함께 글로벌 AI 시장 ‘3강 체제’를 형성하며 경쟁력을 입증하고 있다. 구글은 이러한 기술 통합 역량을 바탕으로 차세대 격전지인 ‘에이전트 경제’ 공략에 속도를 낼 전망이다. 스스로 업무를 계획하고 실행하는 AI 에이전트가 기업 생산성의 핵심 지표로 자리 잡을 것이라는 판단에서다. 쿠리안 CEO는 “에이전트형 기업으로의 전환은 필연적”이라며 “구글은 이미 기술적 준비를 마쳤다”고 강조했다.

구글 클라우드, 제미나이 에이전트 플랫폼·8세대 TPU 공개 [경제일보] 구글 클라우드가 인공지능(AI) 에이전트와 맞춤형 반도체 시장을 동시에 겨냥한 ‘투트랙 전략’을 본격화했다. 구글은 22일(현지시간) 미국 라스베이거스에서 열린 연례 기술 콘퍼런스 ‘구글 클라우드 넥스트 2026’에서 기업용 AI 에이전트 도구인 ‘제미나이 엔터프라이즈 에이전트 플랫폼’을 공개했다. 동시에 훈련과 추론에 각각 특화된 8세대 TPU(텐서 처리장치) ‘8t’와 ‘8i’를 선보이며 AI 인프라 주도권 확보에 나섰다. 현재 기업용 AI 시장에서 가장 확실한 수익 모델은 개발자 중심의 코딩 도구 분야다. 오픈AI의 코덱스(Codex)와 앤트로픽의 클로드 코드(Claude Code)가 경쟁하는 가운데 구글은 상대적으로 존재감이 약했다. 이를 만회하기 위해 구글이 내놓은 제미나이 엔터프라이즈 에이전트 플랫폼은 코딩 지식이 없는 일반 직원도 AI 에이전트를 직접 만들 수 있도록 설계된 것이 특징이다. 개발자 중심 시장을 건너뛰고 기업 실무 전반으로 확산되는 ‘에이전트 생태계’의 주도권을 선점하겠다는 전략으로 풀이된다. 특히 구글은 자사 모델뿐 아니라 앤트로픽의 클로드 모델까지 선택해 사용할 수 있도록 개방형 구조를 채택했다. 토머스 쿠리안 최고경영자(CEO)는 “단편적 서비스가 아니라 혁신을 위한 포괄적 기반을 제공하는 것”이라고 강조했다. 하드웨어 전략도 대대적으로 재편했다. 구글은 8세대 TPU를 훈련용 ‘8t’와 추론용 ‘8i’로 완전히 분리했다. 대규모 모델 학습에는 연산 성능이 높은 8t를, 실시간 서비스 환경에는 지연을 최소화한 8i를 투입하는 구조다. 8t는 인프라 관리 플랫폼 ‘패스웨이’를 통해 단일 클러스터에서 최대 100만 개 칩을 연결할 수 있는 확장성을 갖췄다. 8i는 칩 내부에 384MB 규모의 정적 램(SRAM)을 탑재해 데이터 처리 속도를 크게 끌어올렸다. 또한 구글은 인텔 CPU 대신 자체 설계한 ‘액시온’ 프로세서를 도입해 전력 효율도 개선했다. 이 같은 전략은 엔비디아의 최근 행보와도 유사하다. 엔비디아는 GPU 중심 구조를 유지하면서 추론 특화 칩을 추가하는 방향으로 사업을 확장하고 있다. 업계에서는 양사가 AI 반도체 시장에서 정면 충돌하는 구도가 형성됐다는 분석이 나온다. 특히 추론 전용 가속기는 AI 에이전트 확산과 함께 수요가 급증하는 분야다. 수백만 개 에이전트가 동시에 작동하는 환경에서는 학습보다 실시간 추론 성능이 핵심이 되기 때문이다. 아민 바닷 구글 수석부사장은 “AI 에이전트 시대에는 훈련과 서비스에 각각 최적화된 칩이 필요하다”고 설명했다. 업계는 이번 발표를 계기로 구글이 반도체부터 데이터센터, AI 모델, 개발 도구까지 아우르는 ‘AI 수직계열화’를 완성 단계에 올렸다고 평가한다. 구글은 2015년부터 자체 칩을 설계·운용해온 경험을 강점으로 내세우고 있다. 여기에 자체 모델 ‘제미나이’도 챗GPT, 클로드와 함께 글로벌 AI 시장 ‘3강 체제’를 형성하며 경쟁력을 입증하고 있다. 구글은 이러한 기술 통합 역량을 바탕으로 차세대 격전지인 ‘에이전트 경제’ 공략에 속도를 낼 전망이다. 스스로 업무를 계획하고 실행하는 AI 에이전트가 기업 생산성의 핵심 지표로 자리 잡을 것이라는 판단에서다. 쿠리안 CEO는 “에이전트형 기업으로의 전환은 필연적”이라며 “구글은 이미 기술적 준비를 마쳤다”고 강조했다.2026-04-23 09:15:39

-

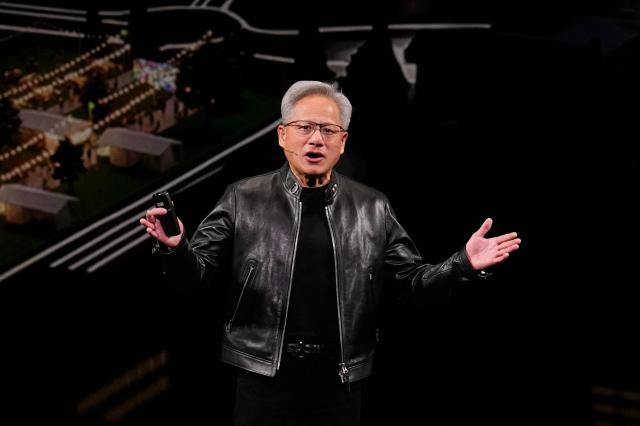

Lessons in Leadership from the Classics | Chapter 4: Nvidia The Patience and the Ascent of Jensen Huang How the Alleyways of Korea and the Floors of Semiconductor Factories Forged the Aesthetics of 古枯孤高 [Economy Daily] At the beating heart of the civilizational upheaval we call artificial intelligence stands one company and one man: Nvidia and Jensen Huang. The world measures them in market capitalization and market share. But the deeper truth of great leadership outlasts any number. It is the power of time, long and unhurried. It is the discipline of subtraction. It is the courage of solitude. And it is, finally, the dignity that comes only from having endured. In the vocabulary of East Asian philosophy, these four qualities compress into a single phrase: 古枯孤高 — ancient (古), austere (枯), solitary (孤), elevated (高). Nvidia's rise is not the story of a stock that spiked overnight. It is the story of these four characters slowly calcifying into the bones of one man and the culture of one company, across thirty years of painstaking accumulation. 古 — The Ancient: Time as the First Discipline Every great enterprise, if it is truly great, eventually earns its face — but only through time. Jensen Huang had been walking this earth as a businessman long before the world knew his name. His relationship with Korea begins here, and it begins on foot. According to domestic industry accounts from that era, Huang made repeated visits to Yongsan Electronics Market in Seoul in the late 1990s and early 2000s — when Nvidia was still an obscure startup struggling to be taken seriously. He came not as a visiting dignitary but as a salesman: explaining graphics cards to shop owners, persuading assemblers, winning trust one transaction at a time. Huang himself has said his connection to Korea dates to 1996. He has spoken of how South Korea's explosion of high-speed internet, its PC-bang culture, and the nationwide fever for StarCraft formed a critical foundation for Nvidia's early growth. Korea, in those years, was the world's most electrified laboratory for digital culture — and the heat of its gaming rooms, the sharpness of its consumers, the velocity with which it embraced new technology, all of it nourished a company that had not yet found its footing. This detail matters enormously. The histories of great corporations are often rewritten to begin in gleaming boardrooms or on famous stages. But Jensen Huang's formation happened in narrow storefronts, surrounded by towers of component boxes, in a market where customers were price-sensitive and performance-obsessed and utterly unimpressed by brand mythology. In Yongsan, he did not sell a brand. He sold credibility. He sold product knowledge. He sold the felt experience of superior performance. The I Ching offers an image for this season of a man's life: 潛龍勿用 — "the hidden dragon does not yet act." The dragon submerged beneath the water has not yet ascended to the sky, but it is already gathering strength, already orienting itself toward its direction. Korea was that submerged time for Jensen Huang. It was where the dragon went quiet and grew. 枯 — The Austere: The Discipline of Withholding Austerity is not poverty. It is restraint. And few companies in the history of Silicon Valley have practiced restraint as rigorously or as consequentially as Nvidia. While its competitors raced to win the surface war — chasing specification numbers, upgrading the cosmetics of their products, playing to the gallery of consumer benchmarks — Huang kept his organization's attention trained on something less visible and far more consequential: the underlying architecture of computation, the logic of parallel processing, the infrastructure that would eventually become the indispensable engine of artificial intelligence. This is the aesthetic the Chinese literati call 枯淡 — a beauty that comes not from ornament but from essence. The Diamond Sutra puts it this way: 凡所有相 皆是虛妄 — "all that has form is ultimately illusion." In business terms: what catches the eye rarely determines a company's fate. What determines fate is the capability that cannot be seen. Nvidia understood this early. That is why the Nvidia of today rests not on the appearance of its products but on the depth of its software ecosystem, its developer base, and the intellectual architecture that competitors cannot easily replicate. This philosophy of austerity extends to Huang's understanding of human character. Speaking at Stanford, he told students that the most important trait for success is not intelligence but resilience — and went further, saying, "I hope you will have the experience of suffering and hardship." It is a startling thing to say, and deliberately so. His point is unambiguous: greatness is not the product of cleverness alone. Character is forged not in comfort but in friction. Huang speaks from experience. He has publicly described being bullied in an American boarding school as a boy, washing dishes and cleaning bathrooms at minimum wage. His philosophy of hardship is not rhetoric. It is autobiography. Most organizations today speak to their people endlessly about well-being and are afraid to speak about tempering. But Jensen Huang did not flinch from the uncomfortable truth: growth always requires some degree of resistance and endurance. He knows this in his body. 孤 — The Solitary: The Courage of the Unfashionable Conviction Solitude, properly understood, is not the condition of being alone. It is the willingness to choose a road that others have not taken — and to walk it long enough to find out whether you were right. Nvidia was, for a very long time, a company that received no particular applause. It was known as a graphics chip company, and in that category, it was formidable. But inside that public identity, Huang carried a private and lonely conviction: that the dominant paradigm of computing would shift — that the age of the general-purpose CPU would eventually yield to an age of accelerated computing. Markets demand the present moment. Leaders sometimes have to absorb today's contempt in exchange for tomorrow's vindication. Only those who sustain that solitude earn the right to the rewards of early arrival. The Analects of Confucius puts it plainly: 德不孤 必有隣 — "virtue is never truly alone; it will always find its neighbors." What appears solitary and eccentric at the beginning eventually draws its community. And in the story of Nvidia and Korea, this movement from isolation to alliance is almost perfectly illustrated. The partnership between Huang and South Korea has long since outgrown its origins in retail sales. SK Hynix began collaborating with Nvidia on High Bandwidth Memory in the uncertain early days of that technology — a bet made before the outcome was clear. That relationship has since deepened into something that resembles co-development more than supply chain. Nvidia has been advancing large-scale AI chip supply and infrastructure cooperation with the Korean government, Samsung, the SK Group, Hyundai Motor Group, and Naver. The lonely salesman who once walked the aisles of Yongsan is now at the table with the leaders of Korean industry and government, shaping the architecture of the nation's AI future. The solitary vigil became a strategic alliance. What was once walked alone is now walked together. 高 — The Elevated: Altitude as Accountability Elevation is not merely position. It is character — the capacity to see farther and to hold responsibility longer than others can or will. The Doctrine of the Mean speaks of 至誠無息 — "true sincerity never rests." This is, unexpectedly, one of the most precise descriptions of how Jensen Huang has run his company. He did not build Nvidia on a passing fashion. He crossed product failures, market cynicism, supply chain crises, and geopolitical headwinds, and climbed — slowly, deliberately, one foothold at a time — to the position the company occupies today. This is not a mountain ascended in a season. This is a summit reached in decades. Here, again, Korea re-enters the story. However regal the title "emperor of the AI era" may sound, the circuitry running through that crown is substantially Korean. Korea began as the consumption frontier — the PC-bang, the gaming market, the early adopter culture that gave Nvidia its first mass foothold. It has since become the strategic frontier: the partner in HBM and advanced memory, the co-architect of AI factories and digital transformation. Between the image of Jensen Huang persuading shop owners in Yongsan and the image of Jensen Huang discussing AI infrastructure with the heads of Korea's largest conglomerates, there runs a very long river. But the river is unbroken. What he first saw in Korea was not merely a sales opportunity. He saw a society with an extraordinary capacity for fast technical comprehension, for organizing technology into industry, for connecting the work of the mind to the work of the factory floor. That insight lives inside every partnership he has built here since. A Reckoning for Korean Business What, then, should Korean business leaders take from this? The lesson is not complicated, though it is demanding. Innovation does not arise from eloquent mission statements. It arises from time endured, from the discipline to discard the inessential, from the independence to pursue an unpopular answer, and from the accountability that eventually transforms all of it into something worthy of the word dignity. Jensen Huang's career is not a story of a man who happened to catch the AI wave at the right moment. It is a story of sediment — of years and decades of experience, discipline, and conviction accumulating until they were precisely aligned with the door that history opened. Which asks certain questions of Korean business. Do we still carry the original instinct of those years when we wrestled with the market on the ground floor — when we had no reputation to trade on, only our knowledge and our reliability? Do we have the austere courage to strip away what is not essential? Do we have the nerve to choose the lonely right answer over the popular wrong one? Management, at its best, is completed in the love of people, in the respect for the work done in the field, and in the refusal to defy the logic of time and nature. The tree that grows too fast is hollow at its core. The success that comes too easily has shallow roots. Nvidia — Jensen Huang's Nvidia — took the opposite path. It stood like an ancient tree, silent and unhurried, enduring the winds and the droughts, growing upward alone toward the high place it had decided, long ago, to reach. His success, for that reason, is not a flash of light. It is light that stays. That is the lesson of 古枯孤高. Only those who have endured long enough ascend high enough. Only those who have passed through austerity reach genuine depth. Only those who have borne solitude long enough find themselves, one day, at the center of their age. Jensen Huang's Korean story is one essential thread in that larger narrative. Today's glory is conceived in yesterday's alleyways. Even the history of the world's most powerful technology company is completed, in the end, only on the accumulated sweat and trust of human beings. He is demonstrating that, quietly, every day. The author is a contributing columnist covering business philosophy, technology, and economic history.

Lessons in Leadership from the Classics | Chapter 4: Nvidia The Patience and the Ascent of Jensen Huang How the Alleyways of Korea and the Floors of Semiconductor Factories Forged the Aesthetics of 古枯孤高 [Economy Daily] At the beating heart of the civilizational upheaval we call artificial intelligence stands one company and one man: Nvidia and Jensen Huang. The world measures them in market capitalization and market share. But the deeper truth of great leadership outlasts any number. It is the power of time, long and unhurried. It is the discipline of subtraction. It is the courage of solitude. And it is, finally, the dignity that comes only from having endured. In the vocabulary of East Asian philosophy, these four qualities compress into a single phrase: 古枯孤高 — ancient (古), austere (枯), solitary (孤), elevated (高). Nvidia's rise is not the story of a stock that spiked overnight. It is the story of these four characters slowly calcifying into the bones of one man and the culture of one company, across thirty years of painstaking accumulation. 古 — The Ancient: Time as the First Discipline Every great enterprise, if it is truly great, eventually earns its face — but only through time. Jensen Huang had been walking this earth as a businessman long before the world knew his name. His relationship with Korea begins here, and it begins on foot. According to domestic industry accounts from that era, Huang made repeated visits to Yongsan Electronics Market in Seoul in the late 1990s and early 2000s — when Nvidia was still an obscure startup struggling to be taken seriously. He came not as a visiting dignitary but as a salesman: explaining graphics cards to shop owners, persuading assemblers, winning trust one transaction at a time. Huang himself has said his connection to Korea dates to 1996. He has spoken of how South Korea's explosion of high-speed internet, its PC-bang culture, and the nationwide fever for StarCraft formed a critical foundation for Nvidia's early growth. Korea, in those years, was the world's most electrified laboratory for digital culture — and the heat of its gaming rooms, the sharpness of its consumers, the velocity with which it embraced new technology, all of it nourished a company that had not yet found its footing. This detail matters enormously. The histories of great corporations are often rewritten to begin in gleaming boardrooms or on famous stages. But Jensen Huang's formation happened in narrow storefronts, surrounded by towers of component boxes, in a market where customers were price-sensitive and performance-obsessed and utterly unimpressed by brand mythology. In Yongsan, he did not sell a brand. He sold credibility. He sold product knowledge. He sold the felt experience of superior performance. The I Ching offers an image for this season of a man's life: 潛龍勿用 — "the hidden dragon does not yet act." The dragon submerged beneath the water has not yet ascended to the sky, but it is already gathering strength, already orienting itself toward its direction. Korea was that submerged time for Jensen Huang. It was where the dragon went quiet and grew. 枯 — The Austere: The Discipline of Withholding Austerity is not poverty. It is restraint. And few companies in the history of Silicon Valley have practiced restraint as rigorously or as consequentially as Nvidia. While its competitors raced to win the surface war — chasing specification numbers, upgrading the cosmetics of their products, playing to the gallery of consumer benchmarks — Huang kept his organization's attention trained on something less visible and far more consequential: the underlying architecture of computation, the logic of parallel processing, the infrastructure that would eventually become the indispensable engine of artificial intelligence. This is the aesthetic the Chinese literati call 枯淡 — a beauty that comes not from ornament but from essence. The Diamond Sutra puts it this way: 凡所有相 皆是虛妄 — "all that has form is ultimately illusion." In business terms: what catches the eye rarely determines a company's fate. What determines fate is the capability that cannot be seen. Nvidia understood this early. That is why the Nvidia of today rests not on the appearance of its products but on the depth of its software ecosystem, its developer base, and the intellectual architecture that competitors cannot easily replicate. This philosophy of austerity extends to Huang's understanding of human character. Speaking at Stanford, he told students that the most important trait for success is not intelligence but resilience — and went further, saying, "I hope you will have the experience of suffering and hardship." It is a startling thing to say, and deliberately so. His point is unambiguous: greatness is not the product of cleverness alone. Character is forged not in comfort but in friction. Huang speaks from experience. He has publicly described being bullied in an American boarding school as a boy, washing dishes and cleaning bathrooms at minimum wage. His philosophy of hardship is not rhetoric. It is autobiography. Most organizations today speak to their people endlessly about well-being and are afraid to speak about tempering. But Jensen Huang did not flinch from the uncomfortable truth: growth always requires some degree of resistance and endurance. He knows this in his body. 孤 — The Solitary: The Courage of the Unfashionable Conviction Solitude, properly understood, is not the condition of being alone. It is the willingness to choose a road that others have not taken — and to walk it long enough to find out whether you were right. Nvidia was, for a very long time, a company that received no particular applause. It was known as a graphics chip company, and in that category, it was formidable. But inside that public identity, Huang carried a private and lonely conviction: that the dominant paradigm of computing would shift — that the age of the general-purpose CPU would eventually yield to an age of accelerated computing. Markets demand the present moment. Leaders sometimes have to absorb today's contempt in exchange for tomorrow's vindication. Only those who sustain that solitude earn the right to the rewards of early arrival. The Analects of Confucius puts it plainly: 德不孤 必有隣 — "virtue is never truly alone; it will always find its neighbors." What appears solitary and eccentric at the beginning eventually draws its community. And in the story of Nvidia and Korea, this movement from isolation to alliance is almost perfectly illustrated. The partnership between Huang and South Korea has long since outgrown its origins in retail sales. SK Hynix began collaborating with Nvidia on High Bandwidth Memory in the uncertain early days of that technology — a bet made before the outcome was clear. That relationship has since deepened into something that resembles co-development more than supply chain. Nvidia has been advancing large-scale AI chip supply and infrastructure cooperation with the Korean government, Samsung, the SK Group, Hyundai Motor Group, and Naver. The lonely salesman who once walked the aisles of Yongsan is now at the table with the leaders of Korean industry and government, shaping the architecture of the nation's AI future. The solitary vigil became a strategic alliance. What was once walked alone is now walked together. 高 — The Elevated: Altitude as Accountability Elevation is not merely position. It is character — the capacity to see farther and to hold responsibility longer than others can or will. The Doctrine of the Mean speaks of 至誠無息 — "true sincerity never rests." This is, unexpectedly, one of the most precise descriptions of how Jensen Huang has run his company. He did not build Nvidia on a passing fashion. He crossed product failures, market cynicism, supply chain crises, and geopolitical headwinds, and climbed — slowly, deliberately, one foothold at a time — to the position the company occupies today. This is not a mountain ascended in a season. This is a summit reached in decades. Here, again, Korea re-enters the story. However regal the title "emperor of the AI era" may sound, the circuitry running through that crown is substantially Korean. Korea began as the consumption frontier — the PC-bang, the gaming market, the early adopter culture that gave Nvidia its first mass foothold. It has since become the strategic frontier: the partner in HBM and advanced memory, the co-architect of AI factories and digital transformation. Between the image of Jensen Huang persuading shop owners in Yongsan and the image of Jensen Huang discussing AI infrastructure with the heads of Korea's largest conglomerates, there runs a very long river. But the river is unbroken. What he first saw in Korea was not merely a sales opportunity. He saw a society with an extraordinary capacity for fast technical comprehension, for organizing technology into industry, for connecting the work of the mind to the work of the factory floor. That insight lives inside every partnership he has built here since. A Reckoning for Korean Business What, then, should Korean business leaders take from this? The lesson is not complicated, though it is demanding. Innovation does not arise from eloquent mission statements. It arises from time endured, from the discipline to discard the inessential, from the independence to pursue an unpopular answer, and from the accountability that eventually transforms all of it into something worthy of the word dignity. Jensen Huang's career is not a story of a man who happened to catch the AI wave at the right moment. It is a story of sediment — of years and decades of experience, discipline, and conviction accumulating until they were precisely aligned with the door that history opened. Which asks certain questions of Korean business. Do we still carry the original instinct of those years when we wrestled with the market on the ground floor — when we had no reputation to trade on, only our knowledge and our reliability? Do we have the austere courage to strip away what is not essential? Do we have the nerve to choose the lonely right answer over the popular wrong one? Management, at its best, is completed in the love of people, in the respect for the work done in the field, and in the refusal to defy the logic of time and nature. The tree that grows too fast is hollow at its core. The success that comes too easily has shallow roots. Nvidia — Jensen Huang's Nvidia — took the opposite path. It stood like an ancient tree, silent and unhurried, enduring the winds and the droughts, growing upward alone toward the high place it had decided, long ago, to reach. His success, for that reason, is not a flash of light. It is light that stays. That is the lesson of 古枯孤高. Only those who have endured long enough ascend high enough. Only those who have passed through austerity reach genuine depth. Only those who have borne solitude long enough find themselves, one day, at the center of their age. Jensen Huang's Korean story is one essential thread in that larger narrative. Today's glory is conceived in yesterday's alleyways. Even the history of the world's most powerful technology company is completed, in the end, only on the accumulated sweat and trust of human beings. He is demonstrating that, quietly, every day. The author is a contributing columnist covering business philosophy, technology, and economic history.2026-04-22 11:57:23

-

![[경전으로 읽는 경영 이야기 | 4편 엔비디아]](https://image.ajunews.com//content/image/2026/04/22/20260422114251720637.jpg) [경제일보] 오늘날 인공지능이라는 거대한 문명 전환의 심장부에는 엔비디아와 젠슨 황이 서 있다. 세상은 그의 회사를 시가총액과 점유율로 기억하지만, 경영의 깊은 본질은 숫자보다 훨씬 오래가는 데 있다. 그것은 오래 묵은 시간의 힘이고, 덜어냄의 절제이며, 홀로 버티는 고독이고, 끝내 높이 서는 품격이다. 이를 동양적 어휘로 압축하면 바로 고고고고, 곧 오래되고(古), 메마르며(枯), 외롭고(孤), 높다(高)는 네 글자다. 엔비디아의 부상은 하루아침의 주가 급등이 아니라, 이 네 글자가 한 경영자의 몸과 조직의 문화 속에서 천천히 굳어져 온 과정의 결과다. 첫째는 고(古)다. 경영은 언제나 시간의 적층 위에서만 비로소 자기 얼굴을 갖는다. 젠슨 황은 오늘의 화려한 무대에 오르기 훨씬 전부터 아시아 시장을 발로 뛰었다. 특히 한국과의 인연은 단순한 고객 관계를 넘어선다. 국내 보도와 당시 업계 회고에 따르면, 그는 엔비디아 초창기인 1990년대 후반과 2000년대 초 서울 용산전자상가를 여러 차례 찾으며 직접 그래픽카드를 설명하고, 매장과 조립 업자들을 설득하며 시장을 일궜다. 황 자신도 한국과의 인연이 1996년부터 시작됐다고 말했고, 한국의 초고속 인터넷 확산과 PC방 문화의 폭발, 스타크래프트 열풍이 엔비디아 성장의 중요한 기반이었다고 설명한 바 있다. 한때 세계 게임 문명의 용광로였던 용산과 PC방의 열기, 그리고 한국 소비자의 빠른 기술 수용성이 무명의 엔비디아를 길러낸 토양이었던 셈이다. 이 대목이 중요한 이유는, 대기업의 역사가 언제나 거대한 회의실에서 시작되는 것이 아니라는 점을 보여주기 때문이다. 오늘의 젠슨 황을 만든 것은 실리콘밸리의 조명만이 아니었다. 좁은 매장, 수많은 부품 상자, 가격에 민감하고 성능에는 더 민감한 한국 시장의 눈높이, 그 치열한 현장이 그를 단련했다. 이름 없는 시절의 젠슨 황은 용산에서 브랜드를 판 것이 아니라 신뢰를 팔았다. 제품 설명 하나, 호환성 하나, 성능의 체감 하나를 놓고 거래처를 설득해야 했다. 경영이란 결국 시장과의 대화라는 사실을 그는 한국의 골목에서 배운 것이다. 주역의 말처럼 '잠룡물용'이라 할 만하다. 물속에 잠긴 용은 아직 하늘로 오르지 못했으되, 이미 힘을 기르고 방향을 정한다. 젠슨 황에게 한국은 그런 잠행의 시간이었다. 둘째는 고(枯)다. 메마름은 빈곤이 아니라 절제다. 엔비디아의 역사는 화려한 외연 확장보다 계산 자원의 본질에 대한 집요한 집중으로 요약된다. 남들이 화면의 겉모습과 사양 경쟁에 몰두할 때, 그는 연산 구조와 병렬처리, 그리고 훗날 AI 시대의 결정적 기반이 되는 가속 컴퓨팅에 집중했다. 이것은 겉을 화려하게 꾸미지 않고 속의 힘을 기르는 기업만이 보여줄 수 있는 고담의 미학이다. 금강경의 “범소유상 개시허망”이라는 말을 굳이 경영에 가져오자면, 눈에 보이는 형상은 늘 유혹적이지만 기업의 운명을 가르는 것은 보이지 않는 핵심 역량이다. 엔비디아는 이를 일찍 알아챘다. 그래서 오늘의 엔비디아는 제품의 외관보다 생태계와 소프트웨어, 그리고 개발자 기반이라는 더 마른 본질 위에 서 있다. 이 절제는 젠슨 황의 인간관에도 이어진다. 그는 스탠퍼드 학생들에게 성공의 핵심은 높은 기대가 아니라 회복탄력성이라고 말하며, “고통과 고난이 있기를 바란다”고까지 했다. 다소 거칠게 들릴 수 있는 이 말의 핵심은 분명하다. 위대함은 총명함만으로 생기지 않으며, 성품과 기질은 편안함 속이 아니라 시련 속에서 벼려진다는 것이다. 실제로 그는 어린 시절 미국 기숙학교에서 괴롭힘을 당했고, 식당에서 접시를 닦고 화장실을 청소하는 등 최저임금 노동을 경험했다고 공개적으로 회고했다. 그러니 그의 인고론은 수사가 아니라 체험에서 나온 말이다. 오늘날 많은 기업이 구성원에게 복지만 말하고 단련을 말하지 못한다. 그러나 젠슨 황은 불편한 진실을 피해가지 않았다. 성장은 언제나 어느 정도의 마찰과 견딤을 동반한다는 점을 그는 몸으로 안다. 셋째는 고(孤)다. 고독은 혼자가 된 상태가 아니라, 남들이 가지 않는 길을 기꺼이 선택하는 용기다. 엔비디아는 오랫동안 모두의 박수를 받는 회사가 아니었다. 그래픽칩 기업으로 알려졌으나, 그 안에서 그는 장차 컴퓨팅의 패러다임이 범용 CPU의 시대에서 가속 컴퓨팅의 시대로 옮겨갈 것이라는 외로운 확신을 품고 있었다. 시장은 늘 당장의 수요를 요구하지만, 경영자는 때로 아직 오지 않은 시간을 위해 오늘의 비난을 감수해야 한다. 이 고독을 견딘 자만이 선점의 과실을 얻는다. 논어의 “덕불고 필유린”이라는 말은 바로 여기에서 생기를 얻는다. 덕은 처음에는 외로워 보여도, 끝내 이웃과 동지를 불러 모은다. 실제로 젠슨 황과 한국의 관계는 이제 단순한 판매 차원을 넘어 전략적 동맹의 수준으로 깊어졌다. SK하이닉스는 불확실성이 높던 HBM 초기부터 엔비디아와 협력을 시작했으며, 최근에는 단순 공급을 넘어 공동 제품 기획 단계로 관계가 진화했다고 밝혔다. 또한 엔비디아는 한국 정부와 삼성전자, SK그룹, 현대차그룹, 네이버 등과 대규모 AI 칩 공급과 인프라 협력을 추진해 왔다. 이는 과거 용산의 외로운 영업이 오늘날 국가와 산업 생태계를 잇는 연대로 전환됐음을 상징한다. 젠슨 황이 과거 한국 시장을 두드리며 얻은 감각은 이제 한국의 메모리, 제조, 자동차, 인터넷 플랫폼과 결합해 하나의 AI 문명 축으로 확장되고 있다. 홀로 버텼던 시간이 마침내 동맹의 언어로 돌아온 것이다. 넷째는 고(高)다. 높음은 단순한 지위가 아니라 품격이다. 높은 곳은 남보다 위에 있다는 뜻이 아니라, 더 멀리 보고 더 오래 책임지는 자리라는 뜻이다. 중용이 말하는 지성무식, 곧 지극한 정성은 쉬지 않는다는 문장은 젠슨 황의 경영을 설명하는 데 의외로 잘 들어맞는다. 그는 한순간의 반짝 유행으로 회사를 키운 인물이 아니다. 수차례의 위기, 제품 실패 가능성, 시장의 냉소, 공급망 압박, 지정학 리스크를 넘어서며 지금의 고지에 올랐다. 그 고지는 하루아침에 오른 산이 아니라, 수십 년간 한 걸음씩 밟아 올린 산이다. 여기서 한국과의 인연은 다시 한 번 중요해진다. 오늘의 엔비디아가 AI 시대의 제왕으로 불린다 해도, 그 왕관의 안쪽에는 한국의 회로가 적지 않게 흐르고 있다. 한국은 초기에는 PC방과 게임 시장으로 엔비디아를 키워준 소비 현장이었고, 이제는 HBM과 첨단 메모리, AI 팩토리와 디지털 전환을 함께 짜는 전략 현장이 되었다. 초창기 젠슨 황이 용산전자상가에서 상인과 조립업자들을 설득하던 모습과, 오늘날 한국의 대기업 총수 및 정부와 함께 AI 인프라를 논하는 모습 사이에는 긴 강이 흐른다. 그러나 그 강의 물줄기는 끊어지지 않았다. 그가 처음 한국에서 본 것은 단지 매출 기회가 아니라 기술을 빨리 이해하고, 산업으로 묶어내며, 현장과 제조를 함께 움직이는 사회의 힘이었을 것이다. 그 통찰이 오늘의 협력으로 이어지고 있다. 우리 기업인들이 여기서 배워야 할 것은 분명하다. 혁신은 화려한 수사에서 나오지 않는다. 오래 버틴 시간, 불필요한 것을 버리는 절제, 외로움을 견디는 독립성, 그리고 끝내 품격으로 승화시키는 책임감에서 나온다. 젠슨 황의 경영은 ‘운 좋게 AI 바람을 탄 사례’가 아니다. 그것은 오래된 시간의 퇴적이 마침내 시대의 문과 맞아떨어진 경우다. 그러므로 대한민국의 경영도 묻지 않을 수 없다. 우리에게는 용산의 바닥에서 시장과 씨름하던 초심이 있는가. 본질이 아닌 것을 덜어내는 메마른 용기가 있는가. 유행과 박수보다 외로운 정답을 선택할 배짱이 있는가. 경영은 결국 사람을 사랑하고, 현장을 존중하며, 시간과 자연의 이치를 거스르지 않는 데서 완성된다. 너무 빨리 크려는 나무는 속이 비고, 너무 쉽게 얻은 성공은 뿌리가 얕다. 젠슨 황의 엔비디아는 그 반대의 길을 걸었다. 늙은 고목처럼 묵묵히 서서 바람과 가뭄을 견디고, 홀로 높은 곳을 향해 자라났다. 그래서 그의 성공은 찰나의 불꽃이 아니라 오래 남는 불빛이다. 고고고고의 미학은 바로 그 점을 일깨운다. 오래 견딘 자만이 높이 오르고, 메마름을 통과한 자만이 깊어지며, 고독을 견딘 자만이 마침내 시대의 중심에 설 수 있다. 젠슨 황의 한국 인연 또한 그 서사의 중요한 한 축이다. 오늘의 영광은 어제의 골목에서 잉태된다는 사실, 세계 최강 기업의 역사도 결국 인간의 땀방울과 신뢰의 축적 위에서만 완성된다는 사실을 그는 조용히 증명하고 있다.

[경제일보] 오늘날 인공지능이라는 거대한 문명 전환의 심장부에는 엔비디아와 젠슨 황이 서 있다. 세상은 그의 회사를 시가총액과 점유율로 기억하지만, 경영의 깊은 본질은 숫자보다 훨씬 오래가는 데 있다. 그것은 오래 묵은 시간의 힘이고, 덜어냄의 절제이며, 홀로 버티는 고독이고, 끝내 높이 서는 품격이다. 이를 동양적 어휘로 압축하면 바로 고고고고, 곧 오래되고(古), 메마르며(枯), 외롭고(孤), 높다(高)는 네 글자다. 엔비디아의 부상은 하루아침의 주가 급등이 아니라, 이 네 글자가 한 경영자의 몸과 조직의 문화 속에서 천천히 굳어져 온 과정의 결과다. 첫째는 고(古)다. 경영은 언제나 시간의 적층 위에서만 비로소 자기 얼굴을 갖는다. 젠슨 황은 오늘의 화려한 무대에 오르기 훨씬 전부터 아시아 시장을 발로 뛰었다. 특히 한국과의 인연은 단순한 고객 관계를 넘어선다. 국내 보도와 당시 업계 회고에 따르면, 그는 엔비디아 초창기인 1990년대 후반과 2000년대 초 서울 용산전자상가를 여러 차례 찾으며 직접 그래픽카드를 설명하고, 매장과 조립 업자들을 설득하며 시장을 일궜다. 황 자신도 한국과의 인연이 1996년부터 시작됐다고 말했고, 한국의 초고속 인터넷 확산과 PC방 문화의 폭발, 스타크래프트 열풍이 엔비디아 성장의 중요한 기반이었다고 설명한 바 있다. 한때 세계 게임 문명의 용광로였던 용산과 PC방의 열기, 그리고 한국 소비자의 빠른 기술 수용성이 무명의 엔비디아를 길러낸 토양이었던 셈이다. 이 대목이 중요한 이유는, 대기업의 역사가 언제나 거대한 회의실에서 시작되는 것이 아니라는 점을 보여주기 때문이다. 오늘의 젠슨 황을 만든 것은 실리콘밸리의 조명만이 아니었다. 좁은 매장, 수많은 부품 상자, 가격에 민감하고 성능에는 더 민감한 한국 시장의 눈높이, 그 치열한 현장이 그를 단련했다. 이름 없는 시절의 젠슨 황은 용산에서 브랜드를 판 것이 아니라 신뢰를 팔았다. 제품 설명 하나, 호환성 하나, 성능의 체감 하나를 놓고 거래처를 설득해야 했다. 경영이란 결국 시장과의 대화라는 사실을 그는 한국의 골목에서 배운 것이다. 주역의 말처럼 '잠룡물용'이라 할 만하다. 물속에 잠긴 용은 아직 하늘로 오르지 못했으되, 이미 힘을 기르고 방향을 정한다. 젠슨 황에게 한국은 그런 잠행의 시간이었다. 둘째는 고(枯)다. 메마름은 빈곤이 아니라 절제다. 엔비디아의 역사는 화려한 외연 확장보다 계산 자원의 본질에 대한 집요한 집중으로 요약된다. 남들이 화면의 겉모습과 사양 경쟁에 몰두할 때, 그는 연산 구조와 병렬처리, 그리고 훗날 AI 시대의 결정적 기반이 되는 가속 컴퓨팅에 집중했다. 이것은 겉을 화려하게 꾸미지 않고 속의 힘을 기르는 기업만이 보여줄 수 있는 고담의 미학이다. 금강경의 “범소유상 개시허망”이라는 말을 굳이 경영에 가져오자면, 눈에 보이는 형상은 늘 유혹적이지만 기업의 운명을 가르는 것은 보이지 않는 핵심 역량이다. 엔비디아는 이를 일찍 알아챘다. 그래서 오늘의 엔비디아는 제품의 외관보다 생태계와 소프트웨어, 그리고 개발자 기반이라는 더 마른 본질 위에 서 있다. 이 절제는 젠슨 황의 인간관에도 이어진다. 그는 스탠퍼드 학생들에게 성공의 핵심은 높은 기대가 아니라 회복탄력성이라고 말하며, “고통과 고난이 있기를 바란다”고까지 했다. 다소 거칠게 들릴 수 있는 이 말의 핵심은 분명하다. 위대함은 총명함만으로 생기지 않으며, 성품과 기질은 편안함 속이 아니라 시련 속에서 벼려진다는 것이다. 실제로 그는 어린 시절 미국 기숙학교에서 괴롭힘을 당했고, 식당에서 접시를 닦고 화장실을 청소하는 등 최저임금 노동을 경험했다고 공개적으로 회고했다. 그러니 그의 인고론은 수사가 아니라 체험에서 나온 말이다. 오늘날 많은 기업이 구성원에게 복지만 말하고 단련을 말하지 못한다. 그러나 젠슨 황은 불편한 진실을 피해가지 않았다. 성장은 언제나 어느 정도의 마찰과 견딤을 동반한다는 점을 그는 몸으로 안다. 셋째는 고(孤)다. 고독은 혼자가 된 상태가 아니라, 남들이 가지 않는 길을 기꺼이 선택하는 용기다. 엔비디아는 오랫동안 모두의 박수를 받는 회사가 아니었다. 그래픽칩 기업으로 알려졌으나, 그 안에서 그는 장차 컴퓨팅의 패러다임이 범용 CPU의 시대에서 가속 컴퓨팅의 시대로 옮겨갈 것이라는 외로운 확신을 품고 있었다. 시장은 늘 당장의 수요를 요구하지만, 경영자는 때로 아직 오지 않은 시간을 위해 오늘의 비난을 감수해야 한다. 이 고독을 견딘 자만이 선점의 과실을 얻는다. 논어의 “덕불고 필유린”이라는 말은 바로 여기에서 생기를 얻는다. 덕은 처음에는 외로워 보여도, 끝내 이웃과 동지를 불러 모은다. 실제로 젠슨 황과 한국의 관계는 이제 단순한 판매 차원을 넘어 전략적 동맹의 수준으로 깊어졌다. SK하이닉스는 불확실성이 높던 HBM 초기부터 엔비디아와 협력을 시작했으며, 최근에는 단순 공급을 넘어 공동 제품 기획 단계로 관계가 진화했다고 밝혔다. 또한 엔비디아는 한국 정부와 삼성전자, SK그룹, 현대차그룹, 네이버 등과 대규모 AI 칩 공급과 인프라 협력을 추진해 왔다. 이는 과거 용산의 외로운 영업이 오늘날 국가와 산업 생태계를 잇는 연대로 전환됐음을 상징한다. 젠슨 황이 과거 한국 시장을 두드리며 얻은 감각은 이제 한국의 메모리, 제조, 자동차, 인터넷 플랫폼과 결합해 하나의 AI 문명 축으로 확장되고 있다. 홀로 버텼던 시간이 마침내 동맹의 언어로 돌아온 것이다. 넷째는 고(高)다. 높음은 단순한 지위가 아니라 품격이다. 높은 곳은 남보다 위에 있다는 뜻이 아니라, 더 멀리 보고 더 오래 책임지는 자리라는 뜻이다. 중용이 말하는 지성무식, 곧 지극한 정성은 쉬지 않는다는 문장은 젠슨 황의 경영을 설명하는 데 의외로 잘 들어맞는다. 그는 한순간의 반짝 유행으로 회사를 키운 인물이 아니다. 수차례의 위기, 제품 실패 가능성, 시장의 냉소, 공급망 압박, 지정학 리스크를 넘어서며 지금의 고지에 올랐다. 그 고지는 하루아침에 오른 산이 아니라, 수십 년간 한 걸음씩 밟아 올린 산이다. 여기서 한국과의 인연은 다시 한 번 중요해진다. 오늘의 엔비디아가 AI 시대의 제왕으로 불린다 해도, 그 왕관의 안쪽에는 한국의 회로가 적지 않게 흐르고 있다. 한국은 초기에는 PC방과 게임 시장으로 엔비디아를 키워준 소비 현장이었고, 이제는 HBM과 첨단 메모리, AI 팩토리와 디지털 전환을 함께 짜는 전략 현장이 되었다. 초창기 젠슨 황이 용산전자상가에서 상인과 조립업자들을 설득하던 모습과, 오늘날 한국의 대기업 총수 및 정부와 함께 AI 인프라를 논하는 모습 사이에는 긴 강이 흐른다. 그러나 그 강의 물줄기는 끊어지지 않았다. 그가 처음 한국에서 본 것은 단지 매출 기회가 아니라 기술을 빨리 이해하고, 산업으로 묶어내며, 현장과 제조를 함께 움직이는 사회의 힘이었을 것이다. 그 통찰이 오늘의 협력으로 이어지고 있다. 우리 기업인들이 여기서 배워야 할 것은 분명하다. 혁신은 화려한 수사에서 나오지 않는다. 오래 버틴 시간, 불필요한 것을 버리는 절제, 외로움을 견디는 독립성, 그리고 끝내 품격으로 승화시키는 책임감에서 나온다. 젠슨 황의 경영은 ‘운 좋게 AI 바람을 탄 사례’가 아니다. 그것은 오래된 시간의 퇴적이 마침내 시대의 문과 맞아떨어진 경우다. 그러므로 대한민국의 경영도 묻지 않을 수 없다. 우리에게는 용산의 바닥에서 시장과 씨름하던 초심이 있는가. 본질이 아닌 것을 덜어내는 메마른 용기가 있는가. 유행과 박수보다 외로운 정답을 선택할 배짱이 있는가. 경영은 결국 사람을 사랑하고, 현장을 존중하며, 시간과 자연의 이치를 거스르지 않는 데서 완성된다. 너무 빨리 크려는 나무는 속이 비고, 너무 쉽게 얻은 성공은 뿌리가 얕다. 젠슨 황의 엔비디아는 그 반대의 길을 걸었다. 늙은 고목처럼 묵묵히 서서 바람과 가뭄을 견디고, 홀로 높은 곳을 향해 자라났다. 그래서 그의 성공은 찰나의 불꽃이 아니라 오래 남는 불빛이다. 고고고고의 미학은 바로 그 점을 일깨운다. 오래 견딘 자만이 높이 오르고, 메마름을 통과한 자만이 깊어지며, 고독을 견딘 자만이 마침내 시대의 중심에 설 수 있다. 젠슨 황의 한국 인연 또한 그 서사의 중요한 한 축이다. 오늘의 영광은 어제의 골목에서 잉태된다는 사실, 세계 최강 기업의 역사도 결국 인간의 땀방울과 신뢰의 축적 위에서만 완성된다는 사실을 그는 조용히 증명하고 있다.2026-04-22 11:43:57

-

SKT, Arm·리벨리온과 손잡고 AI 추론 인프라 구축 [경제일보] 생성형 AI 확산으로 데이터센터 수요가 급증하면서 단순 연산 성능 경쟁을 넘어 전력 효율과 비용 경쟁력 확보가 핵심 변수로 떠오르고 있다. 이에 SK텔레콤은 Arm과 리벨리온의 협업을 통해 10일 SK텔레콤은 Arm, 리벨리온과 차세대 AI 인프라 혁신을 위한 전략적 파트너십(MOU)을 지난 9일 체결했다고 밝혔다. AI 산업 초기에는 대규모 모델을 학습시키기 위한 고성능 GPU 확보가 가장 중요한 과제로 꼽혔다. 다만 최근에는 실제 서비스 운영 단계에서 지속적으로 AI를 실행해야 하는 추론 작업이 늘어나면서 효율성 문제가 부각되고 있다. 추론은 24시간 반복적으로 실행되는 특성상 전력 소비가 높을수록 운영 비용이 급증하는 구조다. 이에 따라 GPU 중심 인프라에서 벗어나 추론에 특화된 AI 반도체 도입 필요성이 커지고 있다. 이에 SK텔레콤은 글로벌 반도체 설계 기업 Arm, 국내 AI 반도체 스타트업 리벨리온과 AI 데이터센터 사업 협력에 나섰다. 세 회사는 Arm의 데이터센터용 CPU와 리벨리온의 AI 추론용 NPU를 결합한 서버 설루션을 공동 개발하고 SK텔레콤 AI 데이터센터에 적용하는 방안을 추진한다. 이를 통해 AI 추론 성능과 전력 효율을 동시에 개선하는 인프라 구축에 나선다는 계획이다. 이번 협력은 CPU와 NPU를 결합한 이종 컴퓨팅 구조 구축을 목표로 진행된다. AI 서비스 운영 과정에서는 AI 연산뿐 아니라 데이터 입출력, 네트워크 통신, 메모리 관리 등 다양한 작업이 동시에 가능하다. CPU는 이 같은 범용 연산과 시스템 운영을 담당하고 NPU는 AI 추론 연산을 전담해 GPU 단일 구조 대비 전력 효율을 높이고 비용을 절감할 전망이다. 리벨리온은 국내 AI 반도체 스타트업 가운데 데이터센터용 AI 칩 개발을 진행하고 있는 기업으로 대규모 AI 서비스 운영에 필요한 저전력·고효율 설계를 앞세워 데이터센터 시장 진입을 추진하고 있다. 이번 협력을 통해 통신사 AI 데이터센터에 직접 적용될 경우 국산 AI 반도체 생태계 확대에도 영향을 미칠 전망이다. Arm 역시 데이터센터 시장 공략에 속도를 내고 있다. 기존 모바일 중심 설계에서 벗어나 데이터센터용 CPU 시장 확대를 추진하며 AI 인프라 영역으로 사업 범위를 넓히고 있다. 전력 효율성이 중요한 AI 데이터센터 환경에서는 Arm 기반 CPU 도입이 늘어나는 추세로 이번 협력은 Arm의 데이터센터 전략 확대 움직임과도 맞물려 있는 것으로 분석된다. SK텔레콤은 AI 데이터센터 사업을 미래 핵심 성장동력으로 삼고 관련 투자를 확대하고 있다. 자체 AI 파운데이션 모델 개발과 함께 인프라 경쟁력 확보를 동시에 추진하며 AI 사업 구조를 강화하고 있다. 이번 협력을 통해 저전력·고효율 추론 인프라를 확보하고 AI 데이터센터 운영 효율성을 높인다는 계획이다. 전력 효율과 비용 경쟁력이 핵심 요소로 떠오르면서 통신사와 반도체 기업 간 협력도 확대되고 있다. AI 산업이 학습 중심에서 추론 중심으로 이동하면서 데이터센터 인프라 경쟁도 새로운 국면에 접어들 전망이다. 이재신 SKT AI 사업개발 담당은 "추론에 최적화된 인프라와 독자 파운데이션 모델 A.X K1을 결합한 풀 패키지를 제공함으로써 AI 데이터센터 경쟁력을 더욱 강화해 나가겠다"고 말했다.

SKT, Arm·리벨리온과 손잡고 AI 추론 인프라 구축 [경제일보] 생성형 AI 확산으로 데이터센터 수요가 급증하면서 단순 연산 성능 경쟁을 넘어 전력 효율과 비용 경쟁력 확보가 핵심 변수로 떠오르고 있다. 이에 SK텔레콤은 Arm과 리벨리온의 협업을 통해 10일 SK텔레콤은 Arm, 리벨리온과 차세대 AI 인프라 혁신을 위한 전략적 파트너십(MOU)을 지난 9일 체결했다고 밝혔다. AI 산업 초기에는 대규모 모델을 학습시키기 위한 고성능 GPU 확보가 가장 중요한 과제로 꼽혔다. 다만 최근에는 실제 서비스 운영 단계에서 지속적으로 AI를 실행해야 하는 추론 작업이 늘어나면서 효율성 문제가 부각되고 있다. 추론은 24시간 반복적으로 실행되는 특성상 전력 소비가 높을수록 운영 비용이 급증하는 구조다. 이에 따라 GPU 중심 인프라에서 벗어나 추론에 특화된 AI 반도체 도입 필요성이 커지고 있다. 이에 SK텔레콤은 글로벌 반도체 설계 기업 Arm, 국내 AI 반도체 스타트업 리벨리온과 AI 데이터센터 사업 협력에 나섰다. 세 회사는 Arm의 데이터센터용 CPU와 리벨리온의 AI 추론용 NPU를 결합한 서버 설루션을 공동 개발하고 SK텔레콤 AI 데이터센터에 적용하는 방안을 추진한다. 이를 통해 AI 추론 성능과 전력 효율을 동시에 개선하는 인프라 구축에 나선다는 계획이다. 이번 협력은 CPU와 NPU를 결합한 이종 컴퓨팅 구조 구축을 목표로 진행된다. AI 서비스 운영 과정에서는 AI 연산뿐 아니라 데이터 입출력, 네트워크 통신, 메모리 관리 등 다양한 작업이 동시에 가능하다. CPU는 이 같은 범용 연산과 시스템 운영을 담당하고 NPU는 AI 추론 연산을 전담해 GPU 단일 구조 대비 전력 효율을 높이고 비용을 절감할 전망이다. 리벨리온은 국내 AI 반도체 스타트업 가운데 데이터센터용 AI 칩 개발을 진행하고 있는 기업으로 대규모 AI 서비스 운영에 필요한 저전력·고효율 설계를 앞세워 데이터센터 시장 진입을 추진하고 있다. 이번 협력을 통해 통신사 AI 데이터센터에 직접 적용될 경우 국산 AI 반도체 생태계 확대에도 영향을 미칠 전망이다. Arm 역시 데이터센터 시장 공략에 속도를 내고 있다. 기존 모바일 중심 설계에서 벗어나 데이터센터용 CPU 시장 확대를 추진하며 AI 인프라 영역으로 사업 범위를 넓히고 있다. 전력 효율성이 중요한 AI 데이터센터 환경에서는 Arm 기반 CPU 도입이 늘어나는 추세로 이번 협력은 Arm의 데이터센터 전략 확대 움직임과도 맞물려 있는 것으로 분석된다. SK텔레콤은 AI 데이터센터 사업을 미래 핵심 성장동력으로 삼고 관련 투자를 확대하고 있다. 자체 AI 파운데이션 모델 개발과 함께 인프라 경쟁력 확보를 동시에 추진하며 AI 사업 구조를 강화하고 있다. 이번 협력을 통해 저전력·고효율 추론 인프라를 확보하고 AI 데이터센터 운영 효율성을 높인다는 계획이다. 전력 효율과 비용 경쟁력이 핵심 요소로 떠오르면서 통신사와 반도체 기업 간 협력도 확대되고 있다. AI 산업이 학습 중심에서 추론 중심으로 이동하면서 데이터센터 인프라 경쟁도 새로운 국면에 접어들 전망이다. 이재신 SKT AI 사업개발 담당은 "추론에 최적화된 인프라와 독자 파운데이션 모델 A.X K1을 결합한 풀 패키지를 제공함으로써 AI 데이터센터 경쟁력을 더욱 강화해 나가겠다"고 말했다.2026-04-10 13:50:06

-

GPU 독주 끝나나…AI 에이전트 시대, CPU 중심 인프라 부상 [경제일보] 생성형 인공지능(AI) 확산으로 GPU 중심으로 형성됐던 AI 인프라 시장이 'AI 에이전트' 시대에 접어들며 CPU 중심으로 재편될 조짐을 보이고 있다. 단순 답변 생성에서 실제 작업을 수행하는 형태로 AI 활용 방식이 변화하면서 데이터센터 구조 자체가 달라지고 있다는 분석이다. 30일 유진투자증권의 보고서 '메모리 와치'에 따르면 초기 생성형 AI는 사용자의 질문에 대한 답변을 생성하는 단순 응답형 구조였지만 단순한 추론을 넘어 실제 행동을 수행하는 구조로 진화하면서 CPU가 담당하는 작업 비중이 크게 늘어나는 것으로 나타났다. 기존 AI는 연산 병목이 대부분 GPU 중심의 행렬 연산과 메모리 대역폭 처리 구간에 집중되며 AI 인프라 경쟁 역시 GPU 확보가 핵심 요소로 작용했다. 다만 최근 등장한 AI 에이전트는 구조가 크게 다르다. AI 에이전트는 사용자의 요청을 해석한 뒤 데이터베이스 접근, 외부 툴 호출, 결과 재분석 등 다층적인 작업을 수행하는 방식으로 동작한다. CPU는 AI 연산 자체를 수행하지는 않지만 요청 해석과 작업 스케줄링, 데이터베이스 접근, 외부 툴 실행, 세션 관리 등 AI 에이전트 워크로드 전반을 제어하는 역할을 담당한다. 이에 AI 인프라의 성능 역시 GPU 단독이 아닌 CPU와 GPU의 조합에 의해 결정되는 구조로 변화하고 있는 것으로 분석된다. 이 같은 변화는 주요 AI 기업들의 전략에서도 나타나고 있다. 최근 엔비디아는 CPU 중심 인프라 확대에 나섰다. 메타는 올해 2월 엔비디아의 '그레이스 CPU'와 '베라 CPU'를 대량 구매하는 공급 계약을 체결했으며 엔비디아는 GTC 2026에서 CPU 개별 판매를 공식화했다. GPU 기업인 엔비디아가 CPU 단독 판매에 나선 것은 이례적인 행보로 평가된다. 이어 엔비디아는 AI 에이전트 환경에 최적화된 '베라 CPU 랙'과 함께 40개 랙으로 구성된 '베라 루빈 포드'도 공개했다. Arm 역시 AI 에이전트 시장 확대에 대응해 데이터센터용 'AGI CPU'를 공개했다. Arm이 직접 칩 판매에 나선 것은 지난 1990년 창립 이후 최초이다. AGI CPU는 메타와 공동 개발됐으며 TSMC 3나노 공정으로 제조된다. Arm은 AI 에이전트 시장 확대로 데이터센터 CPU 시장 규모가 오는 2030년까지 1000억 달러(약 150조원)에 달할 것으로 전망했다. 또한 향후 5년 내 AGI CPU 매출이 Arm의 지난해 연간 매출 46억7000만 달러(약 7조원)를 크게 웃도는 연간 150억 달러(약 23조원)에 이를 것으로 예상했다. 업계에서는 AI 인프라 병목이 GPU에서 메모리, 네트워크를 거쳐 CPU로 이동하고 있는 것으로 예상하고 있다. 초기 AI 사이클에서는 GPU 확보가 핵심이었지만, 추론 시장 확대 이후 KV 캐시 증가로 메모리 수요가 급증했고, 이후 고성능 네트워크 확장 수요가 커지는 것이다. 최근 AI 에이전트 확산으로 비GPU 연산 비중이 빠르게 증가하면서 CPU가 새로운 병목 요인으로 부상할 것으로 전망된다. 이에 GPU와 메모리, 네트워크에 이어 데이터센터 CPU 관련 밸류체인에 대한 투자 관심도 확대될 것으로 분석된다. 르네 하스 Arm 대표는 'AGI CPU'를 공개하며 "AI는 빠르게 진화하고 있으며 앞으로 훨씬 더 빠른 속도로 성장할 것이고, AI 시스템이 복잡해질수록 CPU의 역할은 더욱 중요해질 것"이라며 "AI는 사용자부터 애플리케이션, 인프라까지 전체 기술 스택을 재정의하고 있으며 세계는 기존 데이터센터에서 AI 중심 데이터센터로 빠르게 전환되고 있다"고 말했다.

GPU 독주 끝나나…AI 에이전트 시대, CPU 중심 인프라 부상 [경제일보] 생성형 인공지능(AI) 확산으로 GPU 중심으로 형성됐던 AI 인프라 시장이 'AI 에이전트' 시대에 접어들며 CPU 중심으로 재편될 조짐을 보이고 있다. 단순 답변 생성에서 실제 작업을 수행하는 형태로 AI 활용 방식이 변화하면서 데이터센터 구조 자체가 달라지고 있다는 분석이다. 30일 유진투자증권의 보고서 '메모리 와치'에 따르면 초기 생성형 AI는 사용자의 질문에 대한 답변을 생성하는 단순 응답형 구조였지만 단순한 추론을 넘어 실제 행동을 수행하는 구조로 진화하면서 CPU가 담당하는 작업 비중이 크게 늘어나는 것으로 나타났다. 기존 AI는 연산 병목이 대부분 GPU 중심의 행렬 연산과 메모리 대역폭 처리 구간에 집중되며 AI 인프라 경쟁 역시 GPU 확보가 핵심 요소로 작용했다. 다만 최근 등장한 AI 에이전트는 구조가 크게 다르다. AI 에이전트는 사용자의 요청을 해석한 뒤 데이터베이스 접근, 외부 툴 호출, 결과 재분석 등 다층적인 작업을 수행하는 방식으로 동작한다. CPU는 AI 연산 자체를 수행하지는 않지만 요청 해석과 작업 스케줄링, 데이터베이스 접근, 외부 툴 실행, 세션 관리 등 AI 에이전트 워크로드 전반을 제어하는 역할을 담당한다. 이에 AI 인프라의 성능 역시 GPU 단독이 아닌 CPU와 GPU의 조합에 의해 결정되는 구조로 변화하고 있는 것으로 분석된다. 이 같은 변화는 주요 AI 기업들의 전략에서도 나타나고 있다. 최근 엔비디아는 CPU 중심 인프라 확대에 나섰다. 메타는 올해 2월 엔비디아의 '그레이스 CPU'와 '베라 CPU'를 대량 구매하는 공급 계약을 체결했으며 엔비디아는 GTC 2026에서 CPU 개별 판매를 공식화했다. GPU 기업인 엔비디아가 CPU 단독 판매에 나선 것은 이례적인 행보로 평가된다. 이어 엔비디아는 AI 에이전트 환경에 최적화된 '베라 CPU 랙'과 함께 40개 랙으로 구성된 '베라 루빈 포드'도 공개했다. Arm 역시 AI 에이전트 시장 확대에 대응해 데이터센터용 'AGI CPU'를 공개했다. Arm이 직접 칩 판매에 나선 것은 지난 1990년 창립 이후 최초이다. AGI CPU는 메타와 공동 개발됐으며 TSMC 3나노 공정으로 제조된다. Arm은 AI 에이전트 시장 확대로 데이터센터 CPU 시장 규모가 오는 2030년까지 1000억 달러(약 150조원)에 달할 것으로 전망했다. 또한 향후 5년 내 AGI CPU 매출이 Arm의 지난해 연간 매출 46억7000만 달러(약 7조원)를 크게 웃도는 연간 150억 달러(약 23조원)에 이를 것으로 예상했다. 업계에서는 AI 인프라 병목이 GPU에서 메모리, 네트워크를 거쳐 CPU로 이동하고 있는 것으로 예상하고 있다. 초기 AI 사이클에서는 GPU 확보가 핵심이었지만, 추론 시장 확대 이후 KV 캐시 증가로 메모리 수요가 급증했고, 이후 고성능 네트워크 확장 수요가 커지는 것이다. 최근 AI 에이전트 확산으로 비GPU 연산 비중이 빠르게 증가하면서 CPU가 새로운 병목 요인으로 부상할 것으로 전망된다. 이에 GPU와 메모리, 네트워크에 이어 데이터센터 CPU 관련 밸류체인에 대한 투자 관심도 확대될 것으로 분석된다. 르네 하스 Arm 대표는 'AGI CPU'를 공개하며 "AI는 빠르게 진화하고 있으며 앞으로 훨씬 더 빠른 속도로 성장할 것이고, AI 시스템이 복잡해질수록 CPU의 역할은 더욱 중요해질 것"이라며 "AI는 사용자부터 애플리케이션, 인프라까지 전체 기술 스택을 재정의하고 있으며 세계는 기존 데이터센터에서 AI 중심 데이터센터로 빠르게 전환되고 있다"고 말했다.2026-03-30 17:13:07

-

Arm, 직접 칩 생산 선언…르네 하스 Arm 대표 "세상을 바꿀 기회" [경제일보] Arm이 인공지능(AI) 데이터센터 시장을 겨냥한 자체 중앙처리장치(CPU)를 공개하며 반도체 사업 전략의 대대적인 전환에 나섰다. 설계 자산(IP) 중심 사업 모델에서 벗어나 양산형 실리콘 제품을 직접 공급하는 방식으로 확장하면서 AI 인프라 시장에서 영향력을 확대하려는 움직임으로 풀이된다. 24일(현지시간) Arm은 AI 데이터센터용 CPU인 'Arm AGI CPU'를 발표하고 창사 이래 처음으로 자체 설계한 양산형 실리콘 제품을 제공한다고 밝혔다. 이번 제품은 AI 에이전트 기반 워크로드 확대에 대응하기 위해 개발된 것으로 차세대 AI 인프라 구축을 위한 핵심 컴퓨팅 플랫폼으로 제시됐다. 이를 통해 Arm은 기존 IP 라이선스뿐 아니라 컴퓨팅 서브시스템(CSS), 그리고 완성형 실리콘 제품까지 제공하며 고객 선택지를 확대한다는 구상이다. 그동안 Arm은 반도체 설계 자산을 제공하고 로열티를 받는 사업 모델을 유지해 왔다. 애플, 엔비디아, 퀄컴 등 글로벌 빅테크 기업들이 Arm 설계를 기반으로 자체 칩을 개발하는 방식이었다. 다만 AI 확산으로 데이터센터 인프라 경쟁이 격화되면서 Arm이 직접 실리콘 제품을 공급하는 방향으로 전략을 전환한 것으로 분석된다. 르네 하스 Arm 대표는 "AI 가속기가 CPU를 대체하는 것이 아니라 오히려 CPU는 더 필수적인 파트너가 됐다"며 "AI 데이터센터 시장은 현재 약 30억 달러 규모지만 향후 1000억 달러 시장으로 확대될 것으로 본다"고 설명했다. 특히 AI 기술이 학습 중심에서 추론 및 실행 중심의 '에이전틱 AI'로 발전하면서 CPU 역할이 다시 중요해지고 있다. AI 에이전트는 모델 학습뿐 아니라 추론, 계획, 실행까지 지속적으로 수행하며 시스템 간 데이터를 조율해야 하기 때문에 대규모 CPU 자원이 필요하다. 이에 따라 데이터센터 내 CPU 수요 역시 크게 증가할 것으로 예상된다. Arm은 에이전틱 AI 환경에서 데이터센터의 CPU 요구량이 기존 대비 4배 이상 증가할 것으로 전망했다. 또한 AI 모델 간 상호작용과 실시간 의사결정이 늘어나면서 가속기를 조율하고 데이터 이동을 관리하는 CPU 역할이 핵심 인프라로 부상하고 있는 것으로 분석했다. 르네 하스 대표는 "AI는 빠르게 진화하고 있으며 앞으로 훨씬 더 빠른 속도로 성장할 것이고, AI 시스템이 복잡해질수록 CPU의 역할은 더욱 중요해질 것"이라며 "AI는 사용자부터 애플리케이션, 인프라까지 전체 기술 스택을 재정의하고 있으며 세계는 기존 데이터센터에서 AI 중심 데이터센터로 빠르게 전환되고 있다"고 강조했다. Arm AGI CPU는 이러한 AI 인프라 변화에 맞춰 설계됐다. 해당 CPU는 최대 136개의 Arm Neoverse V3 코어를 탑재하고 코어당 6GB/s 메모리 대역폭과 100ns 미만 지연 시간을 지원한다. Arm은 이번 신제품이 300W 전력 범위에서 동작하며 지속적인 고부하 환경에서도 안정적인 성능을 제공한다고 설명했다. 확장성 측면에서도 대규모 데이터센터 환경을 고려해 설계됐다. 공랭식 서버 기준 랙당 최대 8160개 코어를 지원하며 수랭식 환경에서는 4만5000개 이상의 코어 구성이 가능하고 이를 통해 기존 x86 CPU 대비 랙당 2배 이상의 성능을 제공할 수 있는 것으로 알려졌다. 또한 Arm은 AI 데이터센터 구축 비용 절감 효과도 강조했다. 1GW 규모 AI 데이터센터 기준 최대 100억 달러 수준의 설비 투자 비용 절감이 가능하다는 분석도 제시했다. 이는 전력 효율성과 고밀도 설계를 통한 인프라 비용 절감 효과를 반영한 것이다. 초기 파트너로는 메타가 참여했다. 메타는 Arm AGI CPU 공동 개발 파트너로 참여했으며 자체 AI 가속기인 MTIA와 결합해 AI 인프라 효율을 높일 계획이다. Arm은 향후 여러 세대에 걸쳐 메타와 협력을 이어갈 방침이다. 또한 OpenAI, 클라우드플레어, SAP, SK텔레콤 등 주요 기업들도 초기 파트너로 참여했다. 해당 기업들은 가속기 관리, API 처리, AI 애플리케이션 호스팅 등 다양한 AI 워크로드에 Arm AGI CPU를 활용할 예정으로 알려졌다. 정석근 SK텔레콤 최고기술책임자는 "SK텔레콤은 Arm AGI CPU와 리벨리온 AI 가속기 칩을 포함한 대규모 풀스택 AI 추론 데이터센터 인프라로 사업을 확장하고 있다"며 "자사의 소버린 AI 'A.X' 파운데이션 모델과 추론 최적화 AI 서버를 결합함으로써 이를 글로벌 시장에 제공하기 위한 준비를 완료함과 동시에 AI 데이터센터(AIDC) 경쟁력을 한층 강화하고 있다"고 평가했다. 하드웨어 제조 생태계도 빠르게 확대되고 있다. 레노버, 슈퍼마이크로, 콴타 컴퓨터, 애즈락랙 등이 시스템 구축 파트너로 참여하고 있으며 상용 시스템은 올해 하반기부터 본격 확대될 예정이다. AWS, 구글, 마이크로소프트, 엔비디아, 삼성전자, SK하이닉스, TSMC 등 50개 이상의 기업이 Arm 컴퓨팅 플랫폼 확장을 지원하는 것으로 알려졌다. 그동안 데이터센터 CPU 시장은 인텔과 AMD가 주도해 왔다. Arm 기반 아키텍처가 전력 효율성을 앞세워 클라우드 시장에서 점유율을 확대하고 있는 상황에서 Arm이 직접 CPU 공급에 나서면서 기존 경쟁 구도가 변화할 가능성이 높을 것으로 분석된다. 최근 엔비디아 역시 자체 CPU '베라'를 공개하며 CPU 시장 진입을 선언하는 등 AI 인프라 경쟁이 확대되고 있다. AI 인프라 시장이 빠르게 성장하면서 칩 설계 기업들이 직접 하드웨어 시장으로 진출하는 흐름이 본격화될 전망이다. Arm은 이번 Arm AGI CPU를 시작으로 데이터센터용 실리콘 제품군을 확대할 계획이다. 향후 제품들은 성능, 확장성, 전력 효율성을 중심으로 발전하며 AI 네이티브 데이터센터 아키텍처 구축을 목표로 구성될 예정이다. AI 인프라 경쟁이 본격화되는 가운데 Arm이 설계 기업에서 플랫폼 사업자로 변신을 시도하면서 글로벌 반도체 생태계에도 변화가 가속화될 전망이다.

Arm, 직접 칩 생산 선언…르네 하스 Arm 대표 "세상을 바꿀 기회" [경제일보] Arm이 인공지능(AI) 데이터센터 시장을 겨냥한 자체 중앙처리장치(CPU)를 공개하며 반도체 사업 전략의 대대적인 전환에 나섰다. 설계 자산(IP) 중심 사업 모델에서 벗어나 양산형 실리콘 제품을 직접 공급하는 방식으로 확장하면서 AI 인프라 시장에서 영향력을 확대하려는 움직임으로 풀이된다. 24일(현지시간) Arm은 AI 데이터센터용 CPU인 'Arm AGI CPU'를 발표하고 창사 이래 처음으로 자체 설계한 양산형 실리콘 제품을 제공한다고 밝혔다. 이번 제품은 AI 에이전트 기반 워크로드 확대에 대응하기 위해 개발된 것으로 차세대 AI 인프라 구축을 위한 핵심 컴퓨팅 플랫폼으로 제시됐다. 이를 통해 Arm은 기존 IP 라이선스뿐 아니라 컴퓨팅 서브시스템(CSS), 그리고 완성형 실리콘 제품까지 제공하며 고객 선택지를 확대한다는 구상이다. 그동안 Arm은 반도체 설계 자산을 제공하고 로열티를 받는 사업 모델을 유지해 왔다. 애플, 엔비디아, 퀄컴 등 글로벌 빅테크 기업들이 Arm 설계를 기반으로 자체 칩을 개발하는 방식이었다. 다만 AI 확산으로 데이터센터 인프라 경쟁이 격화되면서 Arm이 직접 실리콘 제품을 공급하는 방향으로 전략을 전환한 것으로 분석된다. 르네 하스 Arm 대표는 "AI 가속기가 CPU를 대체하는 것이 아니라 오히려 CPU는 더 필수적인 파트너가 됐다"며 "AI 데이터센터 시장은 현재 약 30억 달러 규모지만 향후 1000억 달러 시장으로 확대될 것으로 본다"고 설명했다. 특히 AI 기술이 학습 중심에서 추론 및 실행 중심의 '에이전틱 AI'로 발전하면서 CPU 역할이 다시 중요해지고 있다. AI 에이전트는 모델 학습뿐 아니라 추론, 계획, 실행까지 지속적으로 수행하며 시스템 간 데이터를 조율해야 하기 때문에 대규모 CPU 자원이 필요하다. 이에 따라 데이터센터 내 CPU 수요 역시 크게 증가할 것으로 예상된다. Arm은 에이전틱 AI 환경에서 데이터센터의 CPU 요구량이 기존 대비 4배 이상 증가할 것으로 전망했다. 또한 AI 모델 간 상호작용과 실시간 의사결정이 늘어나면서 가속기를 조율하고 데이터 이동을 관리하는 CPU 역할이 핵심 인프라로 부상하고 있는 것으로 분석했다. 르네 하스 대표는 "AI는 빠르게 진화하고 있으며 앞으로 훨씬 더 빠른 속도로 성장할 것이고, AI 시스템이 복잡해질수록 CPU의 역할은 더욱 중요해질 것"이라며 "AI는 사용자부터 애플리케이션, 인프라까지 전체 기술 스택을 재정의하고 있으며 세계는 기존 데이터센터에서 AI 중심 데이터센터로 빠르게 전환되고 있다"고 강조했다. Arm AGI CPU는 이러한 AI 인프라 변화에 맞춰 설계됐다. 해당 CPU는 최대 136개의 Arm Neoverse V3 코어를 탑재하고 코어당 6GB/s 메모리 대역폭과 100ns 미만 지연 시간을 지원한다. Arm은 이번 신제품이 300W 전력 범위에서 동작하며 지속적인 고부하 환경에서도 안정적인 성능을 제공한다고 설명했다. 확장성 측면에서도 대규모 데이터센터 환경을 고려해 설계됐다. 공랭식 서버 기준 랙당 최대 8160개 코어를 지원하며 수랭식 환경에서는 4만5000개 이상의 코어 구성이 가능하고 이를 통해 기존 x86 CPU 대비 랙당 2배 이상의 성능을 제공할 수 있는 것으로 알려졌다. 또한 Arm은 AI 데이터센터 구축 비용 절감 효과도 강조했다. 1GW 규모 AI 데이터센터 기준 최대 100억 달러 수준의 설비 투자 비용 절감이 가능하다는 분석도 제시했다. 이는 전력 효율성과 고밀도 설계를 통한 인프라 비용 절감 효과를 반영한 것이다. 초기 파트너로는 메타가 참여했다. 메타는 Arm AGI CPU 공동 개발 파트너로 참여했으며 자체 AI 가속기인 MTIA와 결합해 AI 인프라 효율을 높일 계획이다. Arm은 향후 여러 세대에 걸쳐 메타와 협력을 이어갈 방침이다. 또한 OpenAI, 클라우드플레어, SAP, SK텔레콤 등 주요 기업들도 초기 파트너로 참여했다. 해당 기업들은 가속기 관리, API 처리, AI 애플리케이션 호스팅 등 다양한 AI 워크로드에 Arm AGI CPU를 활용할 예정으로 알려졌다. 정석근 SK텔레콤 최고기술책임자는 "SK텔레콤은 Arm AGI CPU와 리벨리온 AI 가속기 칩을 포함한 대규모 풀스택 AI 추론 데이터센터 인프라로 사업을 확장하고 있다"며 "자사의 소버린 AI 'A.X' 파운데이션 모델과 추론 최적화 AI 서버를 결합함으로써 이를 글로벌 시장에 제공하기 위한 준비를 완료함과 동시에 AI 데이터센터(AIDC) 경쟁력을 한층 강화하고 있다"고 평가했다. 하드웨어 제조 생태계도 빠르게 확대되고 있다. 레노버, 슈퍼마이크로, 콴타 컴퓨터, 애즈락랙 등이 시스템 구축 파트너로 참여하고 있으며 상용 시스템은 올해 하반기부터 본격 확대될 예정이다. AWS, 구글, 마이크로소프트, 엔비디아, 삼성전자, SK하이닉스, TSMC 등 50개 이상의 기업이 Arm 컴퓨팅 플랫폼 확장을 지원하는 것으로 알려졌다. 그동안 데이터센터 CPU 시장은 인텔과 AMD가 주도해 왔다. Arm 기반 아키텍처가 전력 효율성을 앞세워 클라우드 시장에서 점유율을 확대하고 있는 상황에서 Arm이 직접 CPU 공급에 나서면서 기존 경쟁 구도가 변화할 가능성이 높을 것으로 분석된다. 최근 엔비디아 역시 자체 CPU '베라'를 공개하며 CPU 시장 진입을 선언하는 등 AI 인프라 경쟁이 확대되고 있다. AI 인프라 시장이 빠르게 성장하면서 칩 설계 기업들이 직접 하드웨어 시장으로 진출하는 흐름이 본격화될 전망이다. Arm은 이번 Arm AGI CPU를 시작으로 데이터센터용 실리콘 제품군을 확대할 계획이다. 향후 제품들은 성능, 확장성, 전력 효율성을 중심으로 발전하며 AI 네이티브 데이터센터 아키텍처 구축을 목표로 구성될 예정이다. AI 인프라 경쟁이 본격화되는 가운데 Arm이 설계 기업에서 플랫폼 사업자로 변신을 시도하면서 글로벌 반도체 생태계에도 변화가 가속화될 전망이다.2026-03-25 10:55:20

-

'설계의 제왕' Arm의 반란… 자체 칩 'AGI CPU' 출시로 서버 시장 정조준 [경제일보] 반도체 설계 분야의 절대강자 Arm(암)이 창사 36년 만에 ‘설계도만 파는 기업’이라는 타이틀을 스스로 떼어냈다. 24일(현지시간) Arm은 인공지능(AI) 데이터센터를 겨냥한 자체 중앙처리장치(CPU) ‘Arm AGI CPU’를 전격 출시하며 하드웨어 직접 판매 시장에 뛰어들었다. 이는 단순한 사업 확장을 넘어 칩 설계부터 생산까지 영향력을 확대해 반도체 생태계의 판도를 근본적으로 뒤흔들겠다는 강력한 승부수로 풀이된다. Arm은 1990년 설립 이후 애플, 엔비디아, 퀄컴 등 글로벌 빅테크 기업들에 설계 자산(IP)을 제공하고 로열티를 받는 ‘지식재산권 중심’ 사업 모델을 고수해 왔다. 하지만 전 세계적으로 반도체 가격이 폭등하는 ‘칩플레이션’ 현상이 심화하고 빅테크들이 자체 칩(In-house Chip) 개발에 열을 올리면서 Arm의 사업 모델에도 변화가 요구됐다. 이번에 출시한 ‘Arm AGI CPU’는 대만 TSMC의 3나노(nm) 최첨단 공정으로 제작된다. 300W의 전력 내에서 최대 136개의 코어를 구동해 기존 인텔·AMD 등 ‘x86’ 진영의 CPU 대비 랙(Rack)당 2배 이상의 고성능·저전력 효율을 구현했다. 명칭에 포함된 ‘AGI(범용인공지능)’는 이 칩이 단순히 계산기를 넘어 스스로 판단하고 행동하는 ‘에이전틱 AI(Agentic AI)’ 생태계의 핵심 인프라가 되겠다는 포부를 담고 있다. Arm의 파격적인 변신을 가장 먼저 반긴 것은 메타(Meta)다. 메타는 이번 CPU의 공동 개발 파트너로 참여하며 첫 공급 물량을 확보했다. 메타는 자사의 자체 AI 가속기인 ‘MTIA’와 이번 CPU를 결합해 AI 인프라 효율을 극대화할 계획이다. 여기에 오픈AI, 클라우드플레어 그리고 한국의 SK텔레콤까지 초기 고객사 명단에 이름을 올리며 Arm의 영향력은 빠르게 확산하고 있다. 이러한 행보는 기존 서버 시장을 장악했던 인텔과 AMD의 ‘x86’ 진영에 직접적인 악재로 작용한다. 이미 클라우드 시장에서 ‘Arm 기반 아키텍처’가 저전력·고효율을 앞세워 점유율을 높여온 상황에서 Arm이 직접 완성된 CPU를 내놓으면 기존 고객사들의 이탈이 가속화될 수 있다. GPU 시장을 평정한 엔비디아 역시 최근 연례 회의 ‘GTC 2026’에서 자체 CPU ‘베라(Vera)’를 공개하며 CPU 시장을 압박하고 있는데 Arm의 이번 출시는 칩 설계 기업들이 점차 하드웨어 판매로 무게중심을 옮기고 있음을 극명하게 보여준다. AI의 트렌드가 ‘학습’에서 ‘추론(Inference)’으로 이동하면서 CPU의 중요성은 다시금 커지고 있다. GPU가 막대한 양의 데이터를 쏟아내는 ‘엔진’이라면 그 흐름을 제어하고 지휘하는 ‘지휘관’으로서 CPU의 역할이 강조되고 있기 때문이다. 특히 스스로 판단하고 자율적으로 작업을 수행하는 ‘에이전틱 AI’ 시대에는 복잡한 데이터를 실시간으로 조율할 수 있는 초고성능 CPU가 필수적이다. 다만 Arm의 이러한 전략이 기존 고객사들과의 이해 상돌을 어떻게 극복할지가 관건이다. 설계 기반 기술을 제공하던 기업이 고객사와 직접 경쟁하는 하드웨어 판매자가 되었기 때문이다. 르네 하스 CEO는 “이해 상돌을 고려해 협상 과정에서 기권하겠다”는 등 선을 긋고 있으나 빅테크 기업들이 Arm의 기술력을 신뢰하면서도 동시에 경쟁을 경계하는 이중적인 태도를 유지할 가능성이 높다. 그럼에도 불구하고 업계는 이번 변화를 거스를 수 없는 대세로 보고 있다. 칩플레이션 시대에 더 이상 로열티 수익에만 의존해서는 막대한 R&D 비용을 감당할 수 없다는 판단이 작용했기 때문이다. 삼성전자의 파운드리 역량과 Arm의 초고성능 CPU 설계가 결합하는 등 향후 글로벌 반도체 시장의 공급망 다변화가 가속화될수록 독점적인 구조를 깨뜨릴 Arm의 행보는 시장 생태계를 더욱 역동적으로 만들 전망이다. 한편 Arm의 도약은 ‘설계 기업’이라는 굴레를 벗어던지고 스스로가 지배하는 컴퓨팅 플랫폼을 만들겠다는 선언이다. ‘반도체 영토’를 설계도에서 완제품으로 넓힌 Arm이 인텔과 AMD 그리고 엔비디아라는 거인들이 지배하던 서버 CPU 시장에서 어떤 결과를 낼지 전 세계 반도체 업계의 이목이 쏠리고 있다.

'설계의 제왕' Arm의 반란… 자체 칩 'AGI CPU' 출시로 서버 시장 정조준 [경제일보] 반도체 설계 분야의 절대강자 Arm(암)이 창사 36년 만에 ‘설계도만 파는 기업’이라는 타이틀을 스스로 떼어냈다. 24일(현지시간) Arm은 인공지능(AI) 데이터센터를 겨냥한 자체 중앙처리장치(CPU) ‘Arm AGI CPU’를 전격 출시하며 하드웨어 직접 판매 시장에 뛰어들었다. 이는 단순한 사업 확장을 넘어 칩 설계부터 생산까지 영향력을 확대해 반도체 생태계의 판도를 근본적으로 뒤흔들겠다는 강력한 승부수로 풀이된다. Arm은 1990년 설립 이후 애플, 엔비디아, 퀄컴 등 글로벌 빅테크 기업들에 설계 자산(IP)을 제공하고 로열티를 받는 ‘지식재산권 중심’ 사업 모델을 고수해 왔다. 하지만 전 세계적으로 반도체 가격이 폭등하는 ‘칩플레이션’ 현상이 심화하고 빅테크들이 자체 칩(In-house Chip) 개발에 열을 올리면서 Arm의 사업 모델에도 변화가 요구됐다. 이번에 출시한 ‘Arm AGI CPU’는 대만 TSMC의 3나노(nm) 최첨단 공정으로 제작된다. 300W의 전력 내에서 최대 136개의 코어를 구동해 기존 인텔·AMD 등 ‘x86’ 진영의 CPU 대비 랙(Rack)당 2배 이상의 고성능·저전력 효율을 구현했다. 명칭에 포함된 ‘AGI(범용인공지능)’는 이 칩이 단순히 계산기를 넘어 스스로 판단하고 행동하는 ‘에이전틱 AI(Agentic AI)’ 생태계의 핵심 인프라가 되겠다는 포부를 담고 있다. Arm의 파격적인 변신을 가장 먼저 반긴 것은 메타(Meta)다. 메타는 이번 CPU의 공동 개발 파트너로 참여하며 첫 공급 물량을 확보했다. 메타는 자사의 자체 AI 가속기인 ‘MTIA’와 이번 CPU를 결합해 AI 인프라 효율을 극대화할 계획이다. 여기에 오픈AI, 클라우드플레어 그리고 한국의 SK텔레콤까지 초기 고객사 명단에 이름을 올리며 Arm의 영향력은 빠르게 확산하고 있다. 이러한 행보는 기존 서버 시장을 장악했던 인텔과 AMD의 ‘x86’ 진영에 직접적인 악재로 작용한다. 이미 클라우드 시장에서 ‘Arm 기반 아키텍처’가 저전력·고효율을 앞세워 점유율을 높여온 상황에서 Arm이 직접 완성된 CPU를 내놓으면 기존 고객사들의 이탈이 가속화될 수 있다. GPU 시장을 평정한 엔비디아 역시 최근 연례 회의 ‘GTC 2026’에서 자체 CPU ‘베라(Vera)’를 공개하며 CPU 시장을 압박하고 있는데 Arm의 이번 출시는 칩 설계 기업들이 점차 하드웨어 판매로 무게중심을 옮기고 있음을 극명하게 보여준다. AI의 트렌드가 ‘학습’에서 ‘추론(Inference)’으로 이동하면서 CPU의 중요성은 다시금 커지고 있다. GPU가 막대한 양의 데이터를 쏟아내는 ‘엔진’이라면 그 흐름을 제어하고 지휘하는 ‘지휘관’으로서 CPU의 역할이 강조되고 있기 때문이다. 특히 스스로 판단하고 자율적으로 작업을 수행하는 ‘에이전틱 AI’ 시대에는 복잡한 데이터를 실시간으로 조율할 수 있는 초고성능 CPU가 필수적이다. 다만 Arm의 이러한 전략이 기존 고객사들과의 이해 상돌을 어떻게 극복할지가 관건이다. 설계 기반 기술을 제공하던 기업이 고객사와 직접 경쟁하는 하드웨어 판매자가 되었기 때문이다. 르네 하스 CEO는 “이해 상돌을 고려해 협상 과정에서 기권하겠다”는 등 선을 긋고 있으나 빅테크 기업들이 Arm의 기술력을 신뢰하면서도 동시에 경쟁을 경계하는 이중적인 태도를 유지할 가능성이 높다. 그럼에도 불구하고 업계는 이번 변화를 거스를 수 없는 대세로 보고 있다. 칩플레이션 시대에 더 이상 로열티 수익에만 의존해서는 막대한 R&D 비용을 감당할 수 없다는 판단이 작용했기 때문이다. 삼성전자의 파운드리 역량과 Arm의 초고성능 CPU 설계가 결합하는 등 향후 글로벌 반도체 시장의 공급망 다변화가 가속화될수록 독점적인 구조를 깨뜨릴 Arm의 행보는 시장 생태계를 더욱 역동적으로 만들 전망이다. 한편 Arm의 도약은 ‘설계 기업’이라는 굴레를 벗어던지고 스스로가 지배하는 컴퓨팅 플랫폼을 만들겠다는 선언이다. ‘반도체 영토’를 설계도에서 완제품으로 넓힌 Arm이 인텔과 AMD 그리고 엔비디아라는 거인들이 지배하던 서버 CPU 시장에서 어떤 결과를 낼지 전 세계 반도체 업계의 이목이 쏠리고 있다.2026-03-25 07:49:29

-

'엔비디아-TSMC' 독주 속 '변화의 시작'…삼성-AMD 협력 어디까지 [경제일보] 삼성전자가 미국 반도체 기업 AMD와 손잡고 AI 반도체 시장 주도권 확대에 시동을 걸었다. HBM4 공급을 발판으로 파운드리 협력까지 논의를 확대하며 엔비디아-TSMC 중심 구도에 변화를 예고하고 있다. 삼성전자는 지난 18일 AMD와 업무협약을 체결하고 차세대 AI 가속기용 HBM4 공급 협력을 공식화했다. 삼성전자는 이 협약에 따라 AMD의 '인스팅트 MI455X'용 HBM4 우선 공급사를 맡게 됐다. 양사는 HBM4 공급을 넘어 차세대 반도체 위탁생산(파운드리) 협력까지 논의를 확대하고 있는 것으로 알려졌다. 단순 부품 공급을 넘어 설계·생산 전반을 아우르는 협력 구조로 진화하는 흐름이다. 현재 AI 반도체 시장은 엔비디아의 그래픽처리장치(GPU) 설계 역량과 TSMC의 첨단 공정 기반 위탁생산 체제가 결합된 '엔비디아-TSMC' 중심 구조가 사실상 표준으로 자리 잡고 있다. 엔비디아는 AI 학습과 추론에 최적화된 GPU 아키텍처와 소프트웨어 플랫폼 '쿠다(CUDA)'를 앞세워 AI 가속기 시장을 사실상 주도하고 있다. 이들 칩은 대부분 4나노 이하 첨단 공정을 보유한 TSMC에서 생산되며 설계와 생산이 분리된 글로벌 공급망이 고착화된 모습이다. 이 같은 구조는 높은 기술 장벽과 고객 락인(lock-in) 효과로 경쟁사 진입이 쉽지 않은 환경을 형성해 왔다. AMD와 인텔 등 후발주자들이 GPU 및 AI 가속기 시장에서 점유율 확대를 시도하고 있지만 생산 측면에서는 여전히 TSMC 의존도가 높은 상황이다. 이런 가운데 AMD가 삼성전자와 협력을 확대하며 메모리 공급을 넘어 생산까지 협력 범위를 넓힐 경우 기존 '엔비디아-TSMC' 단일 축에 대응하는 대안 공급망 형성 가능성이 제기되고 있다. 이번 협력의 출발점은 HBM4다. 삼성전자의 HBM4는 AMD의 차세대 AI 가속기 '인스팅트 MI455X'에 탑재될 예정으로 AI 연산 성능을 좌우하는 핵심 부품 공급을 맡게 됐다. AI 모델의 대형화로 데이터 처리 속도가 중요해지면서 HBM의 전략적 가치가 급격히 높아진 상황이다. 양사의 협력은 메모리에 그치지 않는다. 삼성전자는 AMD의 데이터센터 플랫폼과 서버용 중앙처리장치(CPU)에 더블데이터레이트(DDR)5 솔루션 공급도 추진하고 있다. 여기에 파운드리 협력 가능성까지 더해지며 '메모리-시스템반도체-생산'을 잇는 전방위 협력으로 확장되는 양상이다. 특히 시장에서는 AMD가 일부 물량이라도 삼성 파운드리로 전환할 경우 기존 TSMC 중심의 생산 구조에 변화가 생길 수 있다는 관측이 나온다. AMD는 현재 주요 AI 가속기와 서버용 CPU 생산을 대부분 TSMC에 의존하고 있으며 첨단 공정 물량 역시 TSMC에 집중된 상태다. 이런 상황에서 생산 물량이 일부라도 삼성으로 분산될 경우 특정 파운드리에 대한 의존도를 낮추는 동시에 공급망 다변화가 현실화될 수 있다는 분석이다. 이 경우 고객 확보에 어려움을 겪어온 삼성 파운드리에는 실질적인 반전 계기가 될 수 있다. AMD와 같은 대형 고객사를 확보할 경우 단순 매출 확대를 넘어 공정 신뢰도와 수율 경쟁력에 대한 시장 평가도 함께 개선될 가능성이 크기 때문이다. 업계에서는 삼성 파운드리가 대형 고객 레퍼런스를 확보할 경우 추가 고객 유치로 이어지는 '선순환 구조' 진입 가능성도 열려 있다는 평가가 나온다. 업계에서는 이번 협력을 계기로 AI 반도체 시장이 단일 축 중심 구조에서 점차 다변화될 수 있을지에 주목하고 있다. 삼성전자가 메모리 경쟁력을 기반으로 GPU·CPU 등 AI 연산용 시스템반도체 생산(파운드리)까지 영향력을 확대할 수 있을지가 향후 시장 판도를 가를 핵심 변수로 떠오르는 모습이다. 한 반도체 업계 관계자는 "삼성전자와 AMD의 파운드리 협력은 현재로서는 가능성이 열려 있는 단계로 보인다"면서도 "삼성전자와 AMD는 20년 이상 협력 관계를 이어온 만큼 양사 간 시너지가 기대된다"고 말했다. 이어 "삼성전자는 메모리와 파운드리, 로직, 시스템반도체를 아우르는 종합 반도체 기업으로서 원패키지 형태의 솔루션을 제공할 수 있다"며 "이를 기반으로 고객 요구에 보다 빠르게 대응할 수 있는 경쟁력을 갖추고 있다"고 설명했다.

'엔비디아-TSMC' 독주 속 '변화의 시작'…삼성-AMD 협력 어디까지 [경제일보] 삼성전자가 미국 반도체 기업 AMD와 손잡고 AI 반도체 시장 주도권 확대에 시동을 걸었다. HBM4 공급을 발판으로 파운드리 협력까지 논의를 확대하며 엔비디아-TSMC 중심 구도에 변화를 예고하고 있다. 삼성전자는 지난 18일 AMD와 업무협약을 체결하고 차세대 AI 가속기용 HBM4 공급 협력을 공식화했다. 삼성전자는 이 협약에 따라 AMD의 '인스팅트 MI455X'용 HBM4 우선 공급사를 맡게 됐다. 양사는 HBM4 공급을 넘어 차세대 반도체 위탁생산(파운드리) 협력까지 논의를 확대하고 있는 것으로 알려졌다. 단순 부품 공급을 넘어 설계·생산 전반을 아우르는 협력 구조로 진화하는 흐름이다. 현재 AI 반도체 시장은 엔비디아의 그래픽처리장치(GPU) 설계 역량과 TSMC의 첨단 공정 기반 위탁생산 체제가 결합된 '엔비디아-TSMC' 중심 구조가 사실상 표준으로 자리 잡고 있다. 엔비디아는 AI 학습과 추론에 최적화된 GPU 아키텍처와 소프트웨어 플랫폼 '쿠다(CUDA)'를 앞세워 AI 가속기 시장을 사실상 주도하고 있다. 이들 칩은 대부분 4나노 이하 첨단 공정을 보유한 TSMC에서 생산되며 설계와 생산이 분리된 글로벌 공급망이 고착화된 모습이다. 이 같은 구조는 높은 기술 장벽과 고객 락인(lock-in) 효과로 경쟁사 진입이 쉽지 않은 환경을 형성해 왔다. AMD와 인텔 등 후발주자들이 GPU 및 AI 가속기 시장에서 점유율 확대를 시도하고 있지만 생산 측면에서는 여전히 TSMC 의존도가 높은 상황이다. 이런 가운데 AMD가 삼성전자와 협력을 확대하며 메모리 공급을 넘어 생산까지 협력 범위를 넓힐 경우 기존 '엔비디아-TSMC' 단일 축에 대응하는 대안 공급망 형성 가능성이 제기되고 있다. 이번 협력의 출발점은 HBM4다. 삼성전자의 HBM4는 AMD의 차세대 AI 가속기 '인스팅트 MI455X'에 탑재될 예정으로 AI 연산 성능을 좌우하는 핵심 부품 공급을 맡게 됐다. AI 모델의 대형화로 데이터 처리 속도가 중요해지면서 HBM의 전략적 가치가 급격히 높아진 상황이다. 양사의 협력은 메모리에 그치지 않는다. 삼성전자는 AMD의 데이터센터 플랫폼과 서버용 중앙처리장치(CPU)에 더블데이터레이트(DDR)5 솔루션 공급도 추진하고 있다. 여기에 파운드리 협력 가능성까지 더해지며 '메모리-시스템반도체-생산'을 잇는 전방위 협력으로 확장되는 양상이다. 특히 시장에서는 AMD가 일부 물량이라도 삼성 파운드리로 전환할 경우 기존 TSMC 중심의 생산 구조에 변화가 생길 수 있다는 관측이 나온다. AMD는 현재 주요 AI 가속기와 서버용 CPU 생산을 대부분 TSMC에 의존하고 있으며 첨단 공정 물량 역시 TSMC에 집중된 상태다. 이런 상황에서 생산 물량이 일부라도 삼성으로 분산될 경우 특정 파운드리에 대한 의존도를 낮추는 동시에 공급망 다변화가 현실화될 수 있다는 분석이다. 이 경우 고객 확보에 어려움을 겪어온 삼성 파운드리에는 실질적인 반전 계기가 될 수 있다. AMD와 같은 대형 고객사를 확보할 경우 단순 매출 확대를 넘어 공정 신뢰도와 수율 경쟁력에 대한 시장 평가도 함께 개선될 가능성이 크기 때문이다. 업계에서는 삼성 파운드리가 대형 고객 레퍼런스를 확보할 경우 추가 고객 유치로 이어지는 '선순환 구조' 진입 가능성도 열려 있다는 평가가 나온다. 업계에서는 이번 협력을 계기로 AI 반도체 시장이 단일 축 중심 구조에서 점차 다변화될 수 있을지에 주목하고 있다. 삼성전자가 메모리 경쟁력을 기반으로 GPU·CPU 등 AI 연산용 시스템반도체 생산(파운드리)까지 영향력을 확대할 수 있을지가 향후 시장 판도를 가를 핵심 변수로 떠오르는 모습이다. 한 반도체 업계 관계자는 "삼성전자와 AMD의 파운드리 협력은 현재로서는 가능성이 열려 있는 단계로 보인다"면서도 "삼성전자와 AMD는 20년 이상 협력 관계를 이어온 만큼 양사 간 시너지가 기대된다"고 말했다. 이어 "삼성전자는 메모리와 파운드리, 로직, 시스템반도체를 아우르는 종합 반도체 기업으로서 원패키지 형태의 솔루션을 제공할 수 있다"며 "이를 기반으로 고객 요구에 보다 빠르게 대응할 수 있는 경쟁력을 갖추고 있다"고 설명했다.2026-03-19 16:27:21

-

현대차·기아, 엔비디아와 SDV 협력…레벨4 로보택시 개발 추진 [경제일보] 현대자동차와 기아가 인공지능(AI) 반도체 기업 엔비디아와 협력을 확대하며 자율주행과 소프트웨어 중심 자동차(SDV) 개발 체계를 강화한다. 차량용 AI 컴퓨팅 플랫폼을 도입해 자율주행 기술 내재화를 가속하고 향후 레벨4 로보택시 서비스까지 협력 범위를 넓힌다는 구상이다. 17일 업계에 따르면 현대차·기아는 엔비디아와 자율주행 및 SDV 분야 전략적 협력을 확대하기로 했다. 양사는 차량용 인공지능 컴퓨팅 기술과 차량 개발 역량을 결합해 차세대 자율주행 솔루션 공동 개발에 착수한다. 현대차·기아는 현재 차량 소프트웨어 구조를 중심으로 차량 기능을 통합하는 SDV 전환 전략을 추진하고 있다. SDV는 차량의 주요 기능을 하드웨어가 아닌 소프트웨어로 제어하고 업데이트하는 구조로, 자율주행과 차량 데이터 활용을 가능하게 하는 핵심 기술로 평가된다. 이번 협력의 핵심은 엔비디아의 자율주행 플랫폼을 활용한 차량 아키텍처 구축이다. 현대차·기아는 엔비디아의 차량용 통합 플랫폼인 ‘엔비디아 드라이브 하이페리온’을 도입해 자율주행 레벨2부터 레벨4까지 확장 가능한 기술 구조를 구축할 계획이다. 하이페리온은 중앙처리장치(CPU)와 그래픽처리장치(GPU), 라이다·레이더·카메라 등 센서 시스템을 포함한 자율주행 레퍼런스 플랫폼이다. 현대차그룹은 해당 플랫폼을 기반으로 SDV 전용 아키텍처 개발을 추진한다. 차량 데이터 처리, 센서 정보 분석, 인공지능 연산 등을 하나의 구조로 통합해 차량 소프트웨어 기능을 지속적으로 업데이트할 수 있는 체계를 구축한다는 계획이다. 자율주행 기술 단계에서는 레벨2 이상의 첨단운전자보조시스템(ADAS)을 일부 차량에 적용하는 것이 단기 목표다. 중장기적으로는 레벨4 수준의 완전자율주행 서비스까지 기술 적용 범위를 확대한다. 특히 현대차그룹의 미국 자율주행 합작법인 모셔널(Motional)을 중심으로 로보택시 개발 협력도 추진한다. 모셔널은 현대차그룹과 글로벌 모빌리티 기업 앱티브가 설립한 자율주행 합작사로, 미국에서 레벨4 로보택시 상용화를 목표로 기술 개발을 진행하고 있다. 현대차그룹은 엔비디아 플랫폼 도입을 통해 자율주행 데이터 활용 체계도 강화한다. 차량에서 수집되는 영상·주행·행동 데이터 등을 인공지능 학습에 활용하고, 이를 다시 차량 기능 개선에 반영하는 데이터 순환 구조를 구축할 계획이다. 데이터 학습 체계 역시 그룹 단위로 통합한다. 제조·연구개발·차량 운행 과정에서 확보되는 데이터를 하나의 학습 파이프라인으로 통합해 인공지능 학습 효율을 높이는 방식이다. 이를 통해 실제 도로 환경 데이터를 기반으로 자율주행 알고리즘을 고도화할 수 있을 것으로 회사 측은 보고 있다. 김흥수 현대차그룹 GSO(글로벌전략조직) 담당(부사장)은 “엔비디아와의 파트너십 확대는 현대차그룹이 지향하는 ‘안전하고 신뢰할 수 있는’ 자율주행 기술을 구현하기 위한 중요한 모멘텀이 될 것”이라며 “그룹 전반에 걸친 원팀 협력체계를 바탕으로 레벨2 이상의 자율주행 기술부터 레벨4 로보택시 서비스까지 차별화된 기술 경쟁력을 확보해 나가겠다”고 말했다.

현대차·기아, 엔비디아와 SDV 협력…레벨4 로보택시 개발 추진 [경제일보] 현대자동차와 기아가 인공지능(AI) 반도체 기업 엔비디아와 협력을 확대하며 자율주행과 소프트웨어 중심 자동차(SDV) 개발 체계를 강화한다. 차량용 AI 컴퓨팅 플랫폼을 도입해 자율주행 기술 내재화를 가속하고 향후 레벨4 로보택시 서비스까지 협력 범위를 넓힌다는 구상이다. 17일 업계에 따르면 현대차·기아는 엔비디아와 자율주행 및 SDV 분야 전략적 협력을 확대하기로 했다. 양사는 차량용 인공지능 컴퓨팅 기술과 차량 개발 역량을 결합해 차세대 자율주행 솔루션 공동 개발에 착수한다. 현대차·기아는 현재 차량 소프트웨어 구조를 중심으로 차량 기능을 통합하는 SDV 전환 전략을 추진하고 있다. SDV는 차량의 주요 기능을 하드웨어가 아닌 소프트웨어로 제어하고 업데이트하는 구조로, 자율주행과 차량 데이터 활용을 가능하게 하는 핵심 기술로 평가된다. 이번 협력의 핵심은 엔비디아의 자율주행 플랫폼을 활용한 차량 아키텍처 구축이다. 현대차·기아는 엔비디아의 차량용 통합 플랫폼인 ‘엔비디아 드라이브 하이페리온’을 도입해 자율주행 레벨2부터 레벨4까지 확장 가능한 기술 구조를 구축할 계획이다. 하이페리온은 중앙처리장치(CPU)와 그래픽처리장치(GPU), 라이다·레이더·카메라 등 센서 시스템을 포함한 자율주행 레퍼런스 플랫폼이다. 현대차그룹은 해당 플랫폼을 기반으로 SDV 전용 아키텍처 개발을 추진한다. 차량 데이터 처리, 센서 정보 분석, 인공지능 연산 등을 하나의 구조로 통합해 차량 소프트웨어 기능을 지속적으로 업데이트할 수 있는 체계를 구축한다는 계획이다. 자율주행 기술 단계에서는 레벨2 이상의 첨단운전자보조시스템(ADAS)을 일부 차량에 적용하는 것이 단기 목표다. 중장기적으로는 레벨4 수준의 완전자율주행 서비스까지 기술 적용 범위를 확대한다. 특히 현대차그룹의 미국 자율주행 합작법인 모셔널(Motional)을 중심으로 로보택시 개발 협력도 추진한다. 모셔널은 현대차그룹과 글로벌 모빌리티 기업 앱티브가 설립한 자율주행 합작사로, 미국에서 레벨4 로보택시 상용화를 목표로 기술 개발을 진행하고 있다. 현대차그룹은 엔비디아 플랫폼 도입을 통해 자율주행 데이터 활용 체계도 강화한다. 차량에서 수집되는 영상·주행·행동 데이터 등을 인공지능 학습에 활용하고, 이를 다시 차량 기능 개선에 반영하는 데이터 순환 구조를 구축할 계획이다. 데이터 학습 체계 역시 그룹 단위로 통합한다. 제조·연구개발·차량 운행 과정에서 확보되는 데이터를 하나의 학습 파이프라인으로 통합해 인공지능 학습 효율을 높이는 방식이다. 이를 통해 실제 도로 환경 데이터를 기반으로 자율주행 알고리즘을 고도화할 수 있을 것으로 회사 측은 보고 있다. 김흥수 현대차그룹 GSO(글로벌전략조직) 담당(부사장)은 “엔비디아와의 파트너십 확대는 현대차그룹이 지향하는 ‘안전하고 신뢰할 수 있는’ 자율주행 기술을 구현하기 위한 중요한 모멘텀이 될 것”이라며 “그룹 전반에 걸친 원팀 협력체계를 바탕으로 레벨2 이상의 자율주행 기술부터 레벨4 로보택시 서비스까지 차별화된 기술 경쟁력을 확보해 나가겠다”고 말했다.2026-03-17 08:50:13

-

엔비디아 젠슨 황 "삼성에 감사"…삼성전자 GTC서 7세대 HBM4E 최초 공개 [경제일보] 글로벌 인공지능(AI) 패권을 쥐고 있는 엔비디아의 연례 개발자 회의 'GTC 2026' 무대에서 삼성전자(대표 한종희)의 이름이 연신 울려 퍼졌다. 젠슨 황 엔비디아 최고경영자(CEO)가 직접 삼성전자의 파운드리(반도체 위탁생산) 역량을 치켜세운 데 이어 삼성전자는 현장에서 차세대 7세대 고대역폭메모리(HBM4E) 실물을 세계 최초로 공개하며 메모리 시장의 주도권 탈환을 공식화했다. 16일(현지시간) 미국 캘리포니아주 새너제이 SAP센터에서 열린 GTC 2026 기조연설에서 황 CEO는 AI 추론 전용 칩 생태계를 설명하며 "삼성이 우리를 위해 그록(Groq)3 언어처리장치(LPU) 칩을 제조하고 있다"며 "지금 최대한 빠르게 생산을 늘리고 있으며 삼성에게 정말 감사드린다"고 극찬했다. 그록3 LPU는 엔비디아의 차세대 그래픽처리장치(GPU)인 '루빈(Rubin)'과 역할을 분담해 AI 추론 성능과 전력 효율성을 극대화하는 핵심 칩이다. 황 CEO는 이 칩이 올해 하반기인 3분기께 출하가 시작된다고 밝혔다. 그동안 대만 TSMC에 절대적으로 의존해 온 엔비디아가 차세대 핵심 추론 칩 생산을 삼성전자 파운드리에 맡겼다는 사실이 황 CEO의 입을 통해 공식 확인된 셈이다. 이는 단순한 파운드리 수주를 넘어 다가오는 'AI 추론 시대'에 삼성전자가 엔비디아의 대체 불가능한 하드웨어 파트너로 격상되었음을 시사한다. 파운드리 낭보와 함께 삼성전자는 전시장 부스에서 압도적인 메모리 기술력을 과시했다. 지난달 세계 최초로 6세대 HBM4 양산 출하를 선언한 데 이어 이날 행사에서는 한 세대 더 앞선 7세대 'HBM4E' 실물 칩과 적층용 베이스 다이 웨이퍼를 대중에 처음 공개했다. 올해 하반기 샘플 출하를 목표로 하는 HBM4E는 핀당 16Gbps(초당 기가비트) 전송 속도와 4.0TB/s(초당 테라바이트)의 대역폭을 지원한다. 이는 최신작인 HBM4의 13Gbps 전송 속도와 3.3TB/s 대역폭을 훌쩍 뛰어넘는 괴물급 스펙이다. 삼성전자는 10나노급 6세대(1c) D램 공정 기술과 자사 파운드리의 4나노미터(㎚) 베이스 다이 설계 역량을 결합해 이 같은 초격차 성능을 구현했다고 설명했다. 업계에서는 삼성전자가 HBM4 양산 직후 곧바로 HBM4E를 공개한 것을 두고 HBM3와 HBM3E 시장을 선점했던 경쟁사 SK하이닉스의 기선을 제압하기 위한 포석으로 해석한다. 실제로 삼성전자는 전시장 내 'HBM4 히어로 월(Hero Wall)'을 통해 메모리 생산과 파운드리 로직 설계 및 첨단 패키징까지 모두 내부에서 소화하는 종합반도체기업(IDM)만의 '턴키(Turn-key·일괄 생산)' 강점을 전면에 내세웠다. SK하이닉스가 베이스 다이 제작을 위해 TSMC와 연합 전선을 구축한 것과 달리 삼성전자는 설계부터 최종 조립까지 자체적으로 해결해 데이터 병목을 줄이고 납기를 단축할 수 있다는 것이다. 여기에 열 저항을 기존 열압착접합(TCB) 대비 20% 개선하고 16단 이상 고적층을 안정적으로 지원하는 차세대 하이브리드구리접합(HCB) 패키징 기술도 영상을 통해 선보이며 발열 제어 기술에 대한 자신감을 드러냈다. 삼성전자의 공세는 HBM에만 국한되지 않는다. 엔비디아의 차세대 AI 가속기 플랫폼인 '베라 루빈(Vera Rubin)' 생태계 전체를 자사 제품으로 채우겠다는 야심도 드러냈다. 루빈 GPU에 들어가는 HBM4는 물론 중앙처리장치(CPU) '베라'에 탑재될 서버용 저전력 메모리 모듈 소캠(SOCAMM)2와 기업용 6세대 SSD 'PM1763' 스토리지를 함께 전시해 AI 데이터센터 구동에 필요한 모든 형태의 메모리를 공급할 수 있는 토털 솔루션 역량을 부각했다. 이러한 행보는 AI 산업의 무게 중심이 거대언어모델(LLM) '학습'에서 실생활에 적용되는 '추론'으로 이동함에 따라 전력 효율과 공간 최적화가 필수적인 맞춤형(커스텀) 메모리 수요가 폭발적으로 증가하고 있는 배경과 맞닿아 있다. 송용호 삼성전자 AI센터장(부사장)은 17일 GTC 특별 초청 발표 무대에 올라 반도체 제조 과정에서 스스로 학습하고 판단하는 'AI 팩토리' 비전을 공유하고 엔비디아 인프라 혁신을 뒷받침할 삼성전자의 중장기 기술 청사진을 제시할 예정이다. HBM 시장에서 절치부심했던 삼성전자가 2026년을 기점으로 파운드리와 차세대 패키징 융합이라는 승부수를 띄우며 글로벌 AI 반도체 생태계의 판을 근본적으로 뒤흔들고 있다.

엔비디아 젠슨 황 "삼성에 감사"…삼성전자 GTC서 7세대 HBM4E 최초 공개 [경제일보] 글로벌 인공지능(AI) 패권을 쥐고 있는 엔비디아의 연례 개발자 회의 'GTC 2026' 무대에서 삼성전자(대표 한종희)의 이름이 연신 울려 퍼졌다. 젠슨 황 엔비디아 최고경영자(CEO)가 직접 삼성전자의 파운드리(반도체 위탁생산) 역량을 치켜세운 데 이어 삼성전자는 현장에서 차세대 7세대 고대역폭메모리(HBM4E) 실물을 세계 최초로 공개하며 메모리 시장의 주도권 탈환을 공식화했다. 16일(현지시간) 미국 캘리포니아주 새너제이 SAP센터에서 열린 GTC 2026 기조연설에서 황 CEO는 AI 추론 전용 칩 생태계를 설명하며 "삼성이 우리를 위해 그록(Groq)3 언어처리장치(LPU) 칩을 제조하고 있다"며 "지금 최대한 빠르게 생산을 늘리고 있으며 삼성에게 정말 감사드린다"고 극찬했다. 그록3 LPU는 엔비디아의 차세대 그래픽처리장치(GPU)인 '루빈(Rubin)'과 역할을 분담해 AI 추론 성능과 전력 효율성을 극대화하는 핵심 칩이다. 황 CEO는 이 칩이 올해 하반기인 3분기께 출하가 시작된다고 밝혔다. 그동안 대만 TSMC에 절대적으로 의존해 온 엔비디아가 차세대 핵심 추론 칩 생산을 삼성전자 파운드리에 맡겼다는 사실이 황 CEO의 입을 통해 공식 확인된 셈이다. 이는 단순한 파운드리 수주를 넘어 다가오는 'AI 추론 시대'에 삼성전자가 엔비디아의 대체 불가능한 하드웨어 파트너로 격상되었음을 시사한다. 파운드리 낭보와 함께 삼성전자는 전시장 부스에서 압도적인 메모리 기술력을 과시했다. 지난달 세계 최초로 6세대 HBM4 양산 출하를 선언한 데 이어 이날 행사에서는 한 세대 더 앞선 7세대 'HBM4E' 실물 칩과 적층용 베이스 다이 웨이퍼를 대중에 처음 공개했다. 올해 하반기 샘플 출하를 목표로 하는 HBM4E는 핀당 16Gbps(초당 기가비트) 전송 속도와 4.0TB/s(초당 테라바이트)의 대역폭을 지원한다. 이는 최신작인 HBM4의 13Gbps 전송 속도와 3.3TB/s 대역폭을 훌쩍 뛰어넘는 괴물급 스펙이다. 삼성전자는 10나노급 6세대(1c) D램 공정 기술과 자사 파운드리의 4나노미터(㎚) 베이스 다이 설계 역량을 결합해 이 같은 초격차 성능을 구현했다고 설명했다. 업계에서는 삼성전자가 HBM4 양산 직후 곧바로 HBM4E를 공개한 것을 두고 HBM3와 HBM3E 시장을 선점했던 경쟁사 SK하이닉스의 기선을 제압하기 위한 포석으로 해석한다. 실제로 삼성전자는 전시장 내 'HBM4 히어로 월(Hero Wall)'을 통해 메모리 생산과 파운드리 로직 설계 및 첨단 패키징까지 모두 내부에서 소화하는 종합반도체기업(IDM)만의 '턴키(Turn-key·일괄 생산)' 강점을 전면에 내세웠다. SK하이닉스가 베이스 다이 제작을 위해 TSMC와 연합 전선을 구축한 것과 달리 삼성전자는 설계부터 최종 조립까지 자체적으로 해결해 데이터 병목을 줄이고 납기를 단축할 수 있다는 것이다. 여기에 열 저항을 기존 열압착접합(TCB) 대비 20% 개선하고 16단 이상 고적층을 안정적으로 지원하는 차세대 하이브리드구리접합(HCB) 패키징 기술도 영상을 통해 선보이며 발열 제어 기술에 대한 자신감을 드러냈다. 삼성전자의 공세는 HBM에만 국한되지 않는다. 엔비디아의 차세대 AI 가속기 플랫폼인 '베라 루빈(Vera Rubin)' 생태계 전체를 자사 제품으로 채우겠다는 야심도 드러냈다. 루빈 GPU에 들어가는 HBM4는 물론 중앙처리장치(CPU) '베라'에 탑재될 서버용 저전력 메모리 모듈 소캠(SOCAMM)2와 기업용 6세대 SSD 'PM1763' 스토리지를 함께 전시해 AI 데이터센터 구동에 필요한 모든 형태의 메모리를 공급할 수 있는 토털 솔루션 역량을 부각했다. 이러한 행보는 AI 산업의 무게 중심이 거대언어모델(LLM) '학습'에서 실생활에 적용되는 '추론'으로 이동함에 따라 전력 효율과 공간 최적화가 필수적인 맞춤형(커스텀) 메모리 수요가 폭발적으로 증가하고 있는 배경과 맞닿아 있다. 송용호 삼성전자 AI센터장(부사장)은 17일 GTC 특별 초청 발표 무대에 올라 반도체 제조 과정에서 스스로 학습하고 판단하는 'AI 팩토리' 비전을 공유하고 엔비디아 인프라 혁신을 뒷받침할 삼성전자의 중장기 기술 청사진을 제시할 예정이다. HBM 시장에서 절치부심했던 삼성전자가 2026년을 기점으로 파운드리와 차세대 패키징 융합이라는 승부수를 띄우며 글로벌 AI 반도체 생태계의 판을 근본적으로 뒤흔들고 있다.2026-03-17 07:50:01

-

중동 리스크에 증시 변동성 확대…금감원, 증권사 CIO 긴급 소집 [경제일보] 최근 중동 지역의 지정학적 긴장이 고조되면서 글로벌 금융시장의 변동성이 확대되자 금융당국이 증권사 전산 시스템 안정성 점검에 나섰다. 시장 변동성 확대에 따라 주식 거래량이 급증할 가능성이 있는 만큼 전산 장애 등으로 인한 투자자 피해를 사전에 차단하기 위한 조치다. 9일 금융감독원은 이날 오후 서울 여의도 금감원 본원에서 증권사 최고정보책임자(CIO)와 자본시장 유관기관 IT 담당 임원을 대상으로 긴급 점검회의를 개최했다. 이번 회의는 최근 중동 상황으로 자본시장 불안 요인이 확대되는 가운데 증권사 전산시스템 운영 상황과 사고 대응 체계를 점검하기 위해 마련됐다. 회의는 이종오 금감원 디지털·IT 부문 부원장보 주재로 진행됐으며 주요 증권사 13곳의 CIO와 금융투자협회, 한국거래소, 넥스트레이드 등 자본시장 유관기관의 IT 담당 임원들이 참석했다. 참석자들은 최근 금융시장 변동성이 빠르게 확대되는 상황에서 거래 시스템의 안정적 운영 방안을 집중적으로 논의했다. 금감원은 특히 시장 변동성이 커질 경우 투자자들의 매수·매도 주문이 급증하면서 증권사 전산 시스템에 과부하가 발생할 가능성이 있다고 봤다. 전산 장애가 발생할 경우 거래 지연이나 주문 오류 등으로 투자자 피해가 발생할 수 있는 만큼 사전에 철저한 대응 체계를 마련해야 한다는 판단이다. 이에 금감원은 증권사들이 전자금융 인프라의 가용성과 처리 용량을 면밀히 점검할 것을 주문했다. 거래량 급증 상황에 대비해 CPU·메모리·스토리지 등 전산 자원의 임계치를 지속적으로 모니터링하고, 필요할 경우 긴급 전산 자원을 추가 확보하는 등 시스템 처리 능력을 강화해야 한다는 것이다. 또한 시세 조회, 주문 접수와 체결 등 핵심 서비스에 대한 부하 테스트와 성능 점검을 강화해 실제 시장 상황에서도 안정적으로 작동할 수 있도록 대비해야 한다고 강조했다. 아울러 최근 금융시장 상황이 엄중하다는 점을 고려해 이상 거래나 시스템 이상 징후를 조기에 포착할 수 있도록 모니터링 체계를 강화할 것도 요청했다. 비상 상황 발생 시 신속하게 대응할 수 있도록 비상 대응 계획을 재점검하고 실효성 있는 대응 체계를 유지해야 한다는 것이다. 금감원은 전산 장애 등 사고가 발생할 경우 투자자 피해를 최소화하기 위한 대응 절차도 강화할 것을 당부했다. 시스템 장애 발생 시 신속한 복구는 물론 투자자에게 장애 발생 사실과 대체 주문 수단을 즉시 안내해 거래 공백을 최소화해야 한다는 설명이다. 이는 투자자 보호와 시장 신뢰 유지 차원에서 중요한 조치라는 것이 당국의 판단이다. 또한 최근 지정학적 리스크 확대 상황에서 금융회사 시스템을 노린 사이버 공격 가능성도 커질 수 있다고 보고 보안 대응도 강화하기로 했다. 금감원은 디도스(DDoS) 공격이나 랜섬웨어 등 사이버 위협에 대비해 금융회사들이 보안 체계를 철저히 점검하고 대응 능력을 강화할 것을 주문했다. 금감원은 앞으로도 금융회사와 자본시장 유관기관과 긴밀히 협력해 시장 상황에 대응한다는 방침이다. 특히 최근 본격 가동된 금융보안 통합관제 시스템(FIRST)을 활용해 해킹 등 사이버 위협에 대한 취약점 정보를 신속히 공유하고 침해 사고 예방에도 만전을 기할 계획이다. 금감원 관계자는 "시장 상황이 급변하는 상황에서도 전자금융 거래가 안정적으로 제공될 수 있도록 금융회사와 긴밀히 협조해 감독 역량을 집중하겠다"며 "투자자들이 불편 없이 거래할 수 있도록 시스템 안정성 확보와 사이버 보안 대응을 지속적으로 강화할 것"이라고 말했다.

중동 리스크에 증시 변동성 확대…금감원, 증권사 CIO 긴급 소집 [경제일보] 최근 중동 지역의 지정학적 긴장이 고조되면서 글로벌 금융시장의 변동성이 확대되자 금융당국이 증권사 전산 시스템 안정성 점검에 나섰다. 시장 변동성 확대에 따라 주식 거래량이 급증할 가능성이 있는 만큼 전산 장애 등으로 인한 투자자 피해를 사전에 차단하기 위한 조치다. 9일 금융감독원은 이날 오후 서울 여의도 금감원 본원에서 증권사 최고정보책임자(CIO)와 자본시장 유관기관 IT 담당 임원을 대상으로 긴급 점검회의를 개최했다. 이번 회의는 최근 중동 상황으로 자본시장 불안 요인이 확대되는 가운데 증권사 전산시스템 운영 상황과 사고 대응 체계를 점검하기 위해 마련됐다. 회의는 이종오 금감원 디지털·IT 부문 부원장보 주재로 진행됐으며 주요 증권사 13곳의 CIO와 금융투자협회, 한국거래소, 넥스트레이드 등 자본시장 유관기관의 IT 담당 임원들이 참석했다. 참석자들은 최근 금융시장 변동성이 빠르게 확대되는 상황에서 거래 시스템의 안정적 운영 방안을 집중적으로 논의했다. 금감원은 특히 시장 변동성이 커질 경우 투자자들의 매수·매도 주문이 급증하면서 증권사 전산 시스템에 과부하가 발생할 가능성이 있다고 봤다. 전산 장애가 발생할 경우 거래 지연이나 주문 오류 등으로 투자자 피해가 발생할 수 있는 만큼 사전에 철저한 대응 체계를 마련해야 한다는 판단이다. 이에 금감원은 증권사들이 전자금융 인프라의 가용성과 처리 용량을 면밀히 점검할 것을 주문했다. 거래량 급증 상황에 대비해 CPU·메모리·스토리지 등 전산 자원의 임계치를 지속적으로 모니터링하고, 필요할 경우 긴급 전산 자원을 추가 확보하는 등 시스템 처리 능력을 강화해야 한다는 것이다. 또한 시세 조회, 주문 접수와 체결 등 핵심 서비스에 대한 부하 테스트와 성능 점검을 강화해 실제 시장 상황에서도 안정적으로 작동할 수 있도록 대비해야 한다고 강조했다. 아울러 최근 금융시장 상황이 엄중하다는 점을 고려해 이상 거래나 시스템 이상 징후를 조기에 포착할 수 있도록 모니터링 체계를 강화할 것도 요청했다. 비상 상황 발생 시 신속하게 대응할 수 있도록 비상 대응 계획을 재점검하고 실효성 있는 대응 체계를 유지해야 한다는 것이다. 금감원은 전산 장애 등 사고가 발생할 경우 투자자 피해를 최소화하기 위한 대응 절차도 강화할 것을 당부했다. 시스템 장애 발생 시 신속한 복구는 물론 투자자에게 장애 발생 사실과 대체 주문 수단을 즉시 안내해 거래 공백을 최소화해야 한다는 설명이다. 이는 투자자 보호와 시장 신뢰 유지 차원에서 중요한 조치라는 것이 당국의 판단이다. 또한 최근 지정학적 리스크 확대 상황에서 금융회사 시스템을 노린 사이버 공격 가능성도 커질 수 있다고 보고 보안 대응도 강화하기로 했다. 금감원은 디도스(DDoS) 공격이나 랜섬웨어 등 사이버 위협에 대비해 금융회사들이 보안 체계를 철저히 점검하고 대응 능력을 강화할 것을 주문했다. 금감원은 앞으로도 금융회사와 자본시장 유관기관과 긴밀히 협력해 시장 상황에 대응한다는 방침이다. 특히 최근 본격 가동된 금융보안 통합관제 시스템(FIRST)을 활용해 해킹 등 사이버 위협에 대한 취약점 정보를 신속히 공유하고 침해 사고 예방에도 만전을 기할 계획이다. 금감원 관계자는 "시장 상황이 급변하는 상황에서도 전자금융 거래가 안정적으로 제공될 수 있도록 금융회사와 긴밀히 협조해 감독 역량을 집중하겠다"며 "투자자들이 불편 없이 거래할 수 있도록 시스템 안정성 확보와 사이버 보안 대응을 지속적으로 강화할 것"이라고 말했다.2026-03-09 18:12:53

-

KAIST, 엔비디아보다 2.1배 빠른 AI 반도체 '오토GNN' 개발 [이코노믹데일리] 유튜브 영상 추천이나 금융 사기 탐지 등 복잡한 데이터 관계를 분석하는 인공지능(AI)의 속도를 획기적으로 높일 수 있는 반도체 기술이 국내 연구진에 의해 개발됐다. 엔비디아의 최신 그래픽처리장치(GPU)보다 속도는 2배 이상 빠르면서 전력 소모는 대폭 줄인 것이 특징이다. KAIST(총장 이광형)는 전기및전자공학부 정명수 교수 연구팀이 그래프 신경망(GNN) 기반 AI의 추론 속도를 높이는 가속기 기술 ‘오토GNN(AutoGNN)’을 세계 최초로 개발했다고 5일 밝혔다. 그래프 신경망은 사람과 사람 사이의 관계나 데이터 간의 연결성을 분석하는 AI 기술이다. 추천 시스템이나 소셜 네트워크 분석 등에 필수적이지만 본격적인 추론에 앞서 데이터를 정리하는 ‘그래프 전처리’ 과정이 전체 계산 시간의 70~90%를 차지하는 등 고질적인 병목 현상을 겪어왔다. 기존 GPU나 CPU는 규칙적인 데이터 처리에 최적화돼 있어 불규칙하고 복잡한 그래프 데이터를 정리하는 데 한계를 보였기 때문이다. 연구팀은 이 문제를 해결하기 위해 입력되는 데이터 구조에 따라 반도체 내부 회로를 실시간으로 재구성하는 기술을 고안했다. 칩 내부에 필요한 데이터만 골라내는 ‘UPE 모듈’과 이를 빠르게 집계하는 ‘SCR 모듈’을 배치하고, 데이터의 연결성이나 크기가 변할 때마다 최적의 모듈 조합을 자동으로 적용하는 방식이다. 성능 평가 결과 오토GNN은 엔비디아의 고성능 GPU인 ‘RTX 3090’ 대비 2.1배, 서버용 인텔 CPU 대비 9배 빠른 처리 속도를 기록했다. 처리 과정이 효율화되면서 에너지 소모량 또한 GPU 대비 3.3배 절감하는 효과를 거뒀다. 이 기술이 상용화되면 유튜브나 넷플릭스 등 대용량 데이터를 다루는 추천 서비스의 반응 속도가 획기적으로 빨라질 전망이다. 또한 실시간성이 중요한 금융 사기 탐지나 신약 개발 분야에서도 데이터 처리 비용과 시간을 동시에 줄일 수 있을 것으로 기대된다. 정명수 교수는 “불규칙한 데이터 구조를 효과적으로 처리할 수 있는 유연한 하드웨어 시스템을 구현했다는 점에서 의미가 크다”며 “추천 시스템은 물론 금융·보안 등 실시간 분석이 필요한 다양한 AI 분야에 즉시 활용될 것”이라고 말했다. 삼성미래기술육성사업의 지원을 받아 수행된 이번 연구 결과는 지난 4일 호주 시드니에서 열린 컴퓨터 아키텍처 분야 최우수 국제학술대회 ‘HPCA 2026’에서 발표됐다.

KAIST, 엔비디아보다 2.1배 빠른 AI 반도체 '오토GNN' 개발 [이코노믹데일리] 유튜브 영상 추천이나 금융 사기 탐지 등 복잡한 데이터 관계를 분석하는 인공지능(AI)의 속도를 획기적으로 높일 수 있는 반도체 기술이 국내 연구진에 의해 개발됐다. 엔비디아의 최신 그래픽처리장치(GPU)보다 속도는 2배 이상 빠르면서 전력 소모는 대폭 줄인 것이 특징이다. KAIST(총장 이광형)는 전기및전자공학부 정명수 교수 연구팀이 그래프 신경망(GNN) 기반 AI의 추론 속도를 높이는 가속기 기술 ‘오토GNN(AutoGNN)’을 세계 최초로 개발했다고 5일 밝혔다. 그래프 신경망은 사람과 사람 사이의 관계나 데이터 간의 연결성을 분석하는 AI 기술이다. 추천 시스템이나 소셜 네트워크 분석 등에 필수적이지만 본격적인 추론에 앞서 데이터를 정리하는 ‘그래프 전처리’ 과정이 전체 계산 시간의 70~90%를 차지하는 등 고질적인 병목 현상을 겪어왔다. 기존 GPU나 CPU는 규칙적인 데이터 처리에 최적화돼 있어 불규칙하고 복잡한 그래프 데이터를 정리하는 데 한계를 보였기 때문이다. 연구팀은 이 문제를 해결하기 위해 입력되는 데이터 구조에 따라 반도체 내부 회로를 실시간으로 재구성하는 기술을 고안했다. 칩 내부에 필요한 데이터만 골라내는 ‘UPE 모듈’과 이를 빠르게 집계하는 ‘SCR 모듈’을 배치하고, 데이터의 연결성이나 크기가 변할 때마다 최적의 모듈 조합을 자동으로 적용하는 방식이다. 성능 평가 결과 오토GNN은 엔비디아의 고성능 GPU인 ‘RTX 3090’ 대비 2.1배, 서버용 인텔 CPU 대비 9배 빠른 처리 속도를 기록했다. 처리 과정이 효율화되면서 에너지 소모량 또한 GPU 대비 3.3배 절감하는 효과를 거뒀다. 이 기술이 상용화되면 유튜브나 넷플릭스 등 대용량 데이터를 다루는 추천 서비스의 반응 속도가 획기적으로 빨라질 전망이다. 또한 실시간성이 중요한 금융 사기 탐지나 신약 개발 분야에서도 데이터 처리 비용과 시간을 동시에 줄일 수 있을 것으로 기대된다. 정명수 교수는 “불규칙한 데이터 구조를 효과적으로 처리할 수 있는 유연한 하드웨어 시스템을 구현했다는 점에서 의미가 크다”며 “추천 시스템은 물론 금융·보안 등 실시간 분석이 필요한 다양한 AI 분야에 즉시 활용될 것”이라고 말했다. 삼성미래기술육성사업의 지원을 받아 수행된 이번 연구 결과는 지난 4일 호주 시드니에서 열린 컴퓨터 아키텍처 분야 최우수 국제학술대회 ‘HPCA 2026’에서 발표됐다.2026-02-05 08:05:24

-

AMD 실적으로 본 글로벌 AI 수요…국내 AI 투자는 '선별 국면' [이코노믹데일리] AMD의 지난해 4분기 실적이 시장 기대를 웃돌며 글로벌 인공지능(AI) 투자 흐름이 여전히 이어지고 있음을 보여줬다. 데이터센터와 AI 가속기 수요가 실적을 견인하면서 빅테크 중심의 AI 인프라 투자가 지속되고 있다는 신호로 분석된다. 다만 실적 개선의 동력이 기존 고객의 설비 확장에 집중돼 AI 산업 전반의 기술 혁신 속도에 대해서는 보다 신중한 해석이 필요할 것으로 전망된다. 3일(현지시간) AMD는 지난해 4분기 실적을 발표했다. 데이터센터와 AI 가속기 부문 매출이 시장 예상치를 상회하며 성장세를 이어갔다. AI 학습과 추론 수요 확대에 힘입어 데이터센터 매출이 실적 개선을 주도하면서 글로벌 AI 인프라 투자가 여전히 진행 중인 것으로 분석된다. AMD에 따르면 지난해 4분기 매출은 102억7000만 달러(약 14조9000억원)로 전년 동기 76억5800만 달러(약 11조1000억원) 대비 34% 증가했다. 이는 월가 예상치인 96억 달러(약 13조9000억원)를 웃도는 수준이다. 영업이익은 17억5200만 달러(약 2조5000억원)로 전년 동기 8억7100만 달러(약 1조2000억원) 대비 101% 증가했다. 실적 성장은 데이터센터 부문이 견인했다. AMD는 데이터센터 매출이 전년 대비 39% 증가한 54억 달러(약 7조8400억원)를 기록했다고 설명했다. 해당 매출 성장은 클라우드 기업과 대형 플랫폼 기업들의 AI 인프라 투자 확대가 반영된 결과로 풀이된다. 클라이언트·게이밍 부문 매출 역시 같은 기간 37% 증가한 39억 달러(약 5조6600억원)를 기록하며 전반적인 수요 회복 흐름을 나타냈다. AMD 등 글로벌 IT 기업의 실적은 글로벌 AI 투자 흐름을 가늠하는 선행 지표로 작용한다. 특히 AI 반도체 시장을 주도하는 엔비디아의 실적 발표를 앞두고 투자 심리를 확인할 수 있는 지표로서 활용 가능한 것으로 알려졌다. 이번 분기는 AI 반도체 수요가 여전히 견조하다는 점은 확인됐지만 성장의 질에 대한 평가는 엇갈리고 있다. AI 모델 고도화와 서비스 확산에 따라 연산 수요는 계속 증가하고 있지만 기술적 혁신이 폭발적으로 나타났다고 보기는 어려운 것으로 분석된다. 현재 시장 성장은 새로운 기술 도약보다는 기존 빅테크 기업들의 데이터센터 확장과 GPU·가속기 도입 확대에 의해 유지되고 있는 것으로 평가된다. 공급망 변수 역시 여전히 존재한다. 글로벌 메모리 반도체 공급 부족과 고성능 GPU 및 AI 가속기 생산 병목 현상은 단기 리스크로 지목된다. AI 인프라 투자가 이어지더라도 첨단 반도체 생산 능력과 공급망 안정성이 산업 성장 속도를 좌우할 가능성이 클 것으로 전망된다. 글로벌 AI 반도체 수요가 유지되고 있다는 점은 국내 AI 스타트업과 플랫폼 기업들이 당장 투자 위축을 우려할 단계는 아니라는 의미로도 풀이된다. 다만 기술 혁신 속도가 기대에 미치지 못했다는 평가는 국내 기업에도 냉정한 신호로 작용할 수 있다. 단순한 모델 규모 확장이나 연산 자원 확보 경쟁만으로는 경쟁력을 확보하기 어려워질 전망이다. 향후 AI 산업이 초기 투자 확대 국면에서 실제 서비스 적용과 수익성을 검증하는 단계로 이동하고 있는 것으로도 분석된다. 기업들이 AI 기술을 활용해 실제 비즈니스 성과를 만들어내지 못할 경우 투자 속도 역시 조정될 수 있을 것으로 풀이된다. 특히 반도체와 클라우드 인프라에 대한 투자는 유지되겠지만 투자 효율성과 수익성에 대한 검증 기준은 한층 엄격해질 것으로 전망된다. 글로벌 빅테크 기업들의 AI 지출이 선택과 집중 국면으로 접어들 경우 국내 AI 기업 역시 기술 경쟁력과 사업 모델을 동시에 입증해야 하는 환경에 놓일 가능성이 클 것으로 평가된다. 실적 발표 이후 진행된 컨퍼런스 콜에서 리사 수 AMD 최고경영자는 "지난해는 고성능 AI 플랫폼의 수요 확대로 기록적 수익을 달성했다"며 "에픽·라이젠 CPU 채택 가속과 데이터센터 AI 프랜차이즈의 빠른 확장으로 올해도 강력한 모멘텀이 지속될 것"이라고 말했다.